Установка Платформы Astra Cloud с помощью Подсистемы развертывания и настройки#

Описание возможного сценария развертывания инфраструктуры#

Ключевые этапы развертывания инфраструктуры:

запуск виртуальной машины Astra Cloud Installer сервера (Подсистемы развертывания и настройки) из Qcow2-образа;

загрузка ISO из личного кабинета в специальные директории на Astra Cloud Installer сервере;

установка ОС на целевых серверах;

создание служебных виртуальных машин на целевых серверах;

подготовка и исполнение сценария установки основных компонентов, кроме СРК RuBackup (далее - Средство Резервного Копирования, СРК), Astra Monitoring, BILLmanager, DCImanager, Marketplace;

подключение iSCSI хранилищ к ПК СВ «Брест» (далее - ПК СВ, Подсистема виртуализации, Портал администратора);

развертывание ВМ со Средством резервного копирования, Astra Monitoring, BILLmanager, DCImanager и Marketplace внутри Подсистемы виртуализации.

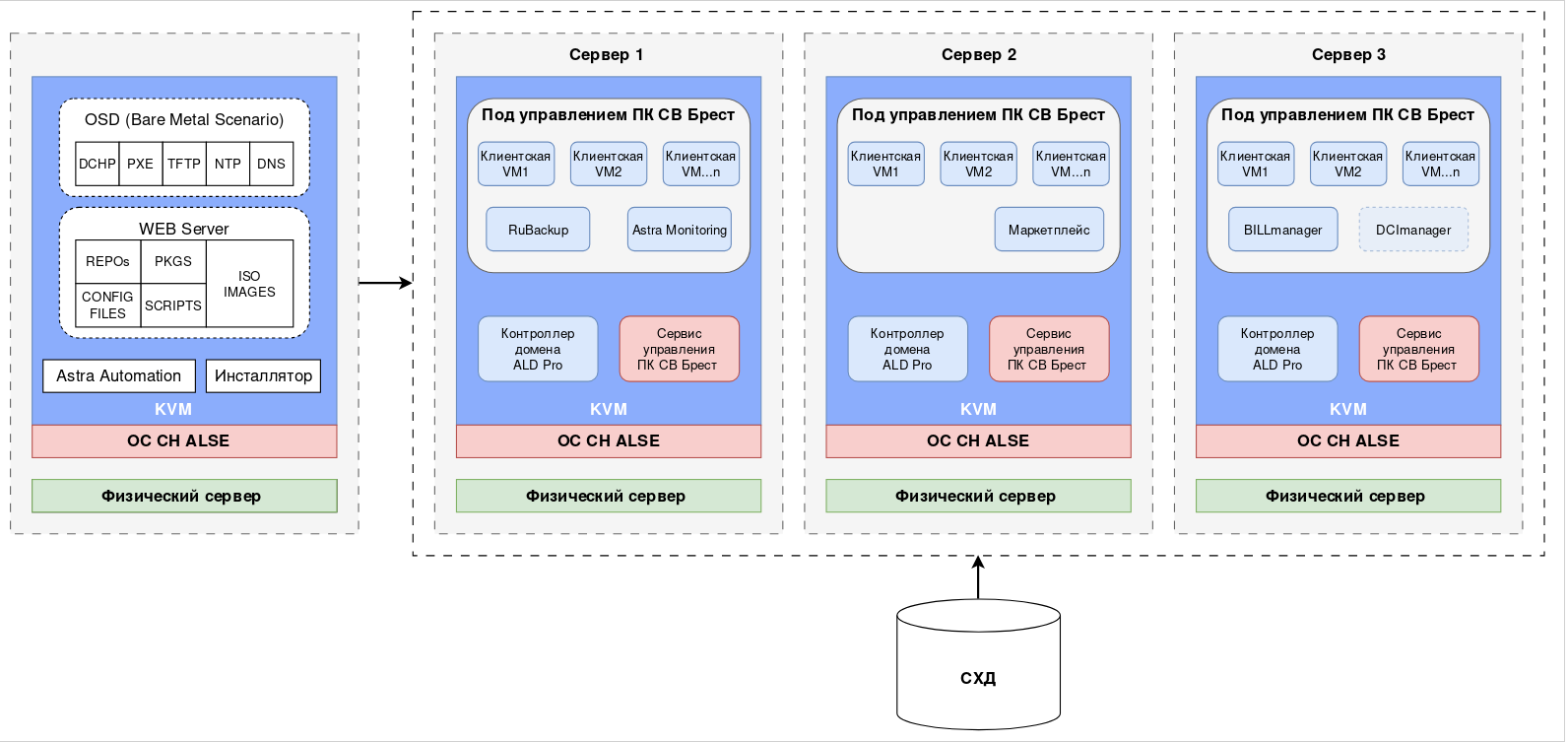

Минимальная инфраструктура состоит из трех целевых серверов виртуализации, на них же размещаются служебные виртуальные машины серверов управления и контроллера домена.

Схема расположения служб и виртуальных машин на целевых серверах:

Версионность продуктов:#

ПК СВ «Брест» — 4.0.0;

ALD Pro — 3.0.0;

RuBackup — 2.7;

Astra Monitoring — 1.0;

BILLmanager — 6.132 (редакция Hosting&Cloud);

DCImanager — 6;

Astra Linux — SE 1.8.3.UU1, SE 1.7.6.UU2. Версия 1.8.3.UU1 (далее 1.8.3.8) используется для серверов управления и виртуализации ПК СВ «Брест», СРК RuBackup, * Astra Monitoring. Версия 1.7.6.UU2 (далее 1.7.6.15) для всех остальных серверов облачной платформы кроме DCImanager, для него используется версия ALSE 1.7.4.UU1.

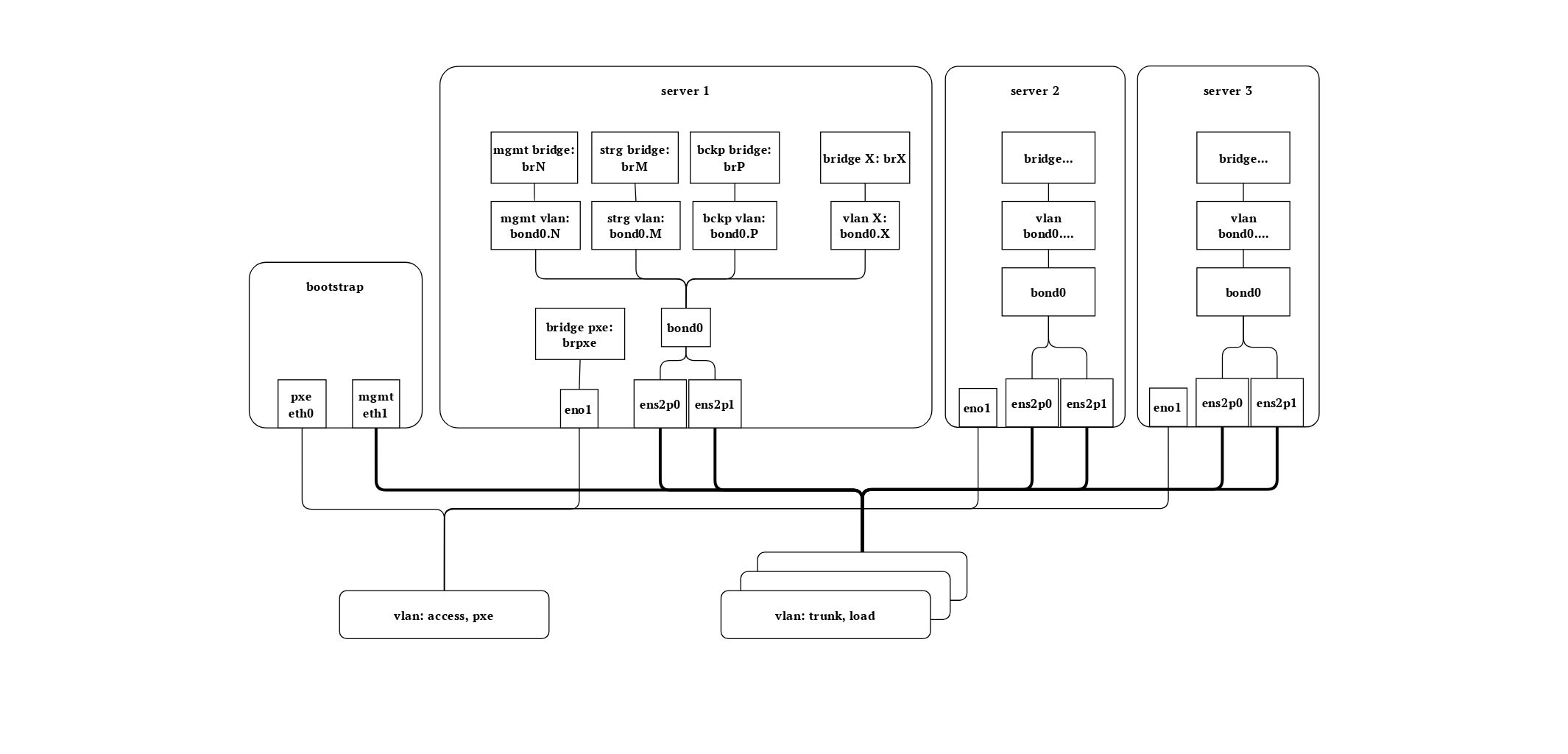

Сетевая топология#

Правильная настройка сетевых подключений является критической для успешной установки платформы и дальнейшей ее работы.

Рекомендуемая схема сетевого подключения:

Примечание

Данная схема является минимальной рабочей топологией. Она может быть расширена и дополнена, но не может быть упрощена.

Схема описывает сетевые соединения серверов виртуализации, топологию сетевых интерфейсов с точки зрения операционной системы, а также относительное расположение сервера Astra Cloud Installer.

Для работы как Подсистемы развертывания и настройки, так и самой Платформы Astra Cloud требуются следующие сети:

PXE, используемая для сетевой установки ОС;

Management, которая используется во время установки платформы;

Storage, которая соединяет серверы виртуализации с СХД (iSCSI);

Backup для резервного копирования.

Сеть PXE должна быть нетегируемой (access), остальные, учитывая ожидаемую топологию, — тегируемые (trunk).

Примечание

На серверах виртуализации не допускается использование названий интерфейсов вида ethX. Это связано с особенностями работы агрегации сетевых каналов (bond). При сетевой автоматической установке ОС параметр ядра net.ifnames=0, который необходимо убрать, убирается автоматически. На сервере Astra Cloud Installer механизм наименования сетевых интерфейсов значения не имеет.

Предупреждение

Необходимо выделять отдельный физический канал для целей сетевой установки ОС (PXE). Выделение отдельного физического канала для резервного копирования (Backup) допускается и рекомендуется, но не является обязательным.

Примечание

Для именования сетевых интерфейсов применяется один из двух методов:

Традиционный метод: система назначает имя ethX в момент инициализации интерфейса (определяется в параметрах загрузки:

net.ifnames=0).Механизм predictable names назначает имя вида

eno1илиens1p0, в соответствии с расположением устройства в древе PCI.

В целях обеспечения отказоустойчивости сетевого подключения, производится агрегация сетевых интерфейсов в соединения типа bond. В связи с тем, что инициализация оборудования выполняется асинхронно, при использовании традиционного метода именования интерфейсов, в процессе загрузки сервера, имена портов могут изменяться (например, порт eth1 сменит название на eth0), что может привести к некорректной агрегации сетевых интерфейсов.

Механизм predictable names позволяет избежать данной проблемы, т.к., при его использовании, устройства получают одни и те же имена, в зависимости от расположения в древе PCI.

Однако, в зависимости от установленного оборудования, традиционное именование может оказаться более удобным в процессах эксплуатации и документирования кластера.

Для сохранения традиционного метода наименования и закрепления за сетевыми интерфейсами стабильных имен, может быть прописано правило udev.

Добавление правила udev и включение традиционного именования интерфейсов не является строго обязательным и выполняется на усмотрение администратора.

В процессе автоматической установки ОС из параметров загрузки убирается параметр net.ifnames=0, что включает механизм predictable names. Для его отключения следует:

На уже установленной ОС вернуть параметр

net.ifnames=0, отредактировав в файле/etc/default/grubстрокуGRUB_CMDLINE_LINUX_DEFAULT:#GRUB_CMDLINE_LINUX_DEFAULT="<param> net.ifnames=0 <param>"

Обновить

grub.cfgкомандой:update-grub

Привязать соответствующие имена к MAC-адресам интерфейсов в новом правиле

udev:# /etc/udev/rules.d/10-network-names.rules SUBSYSTEM=="net", ACTION=="add", ATTR{address}=="aa:bb:cc:dd:ee:11", NAME="eth0" SUBSYSTEM=="net", ACTION=="add", ATTR{address}=="aa:bb:cc:dd:ee:22", NAME="eth1" SUBSYSTEM=="net", ACTION=="add", ATTR{address}=="aa:bb:cc:dd:ee:33", NAME="eth2"

Поставить

systemdзапрет на переписывание переименованных интерфейсов, выполнив команду:sudo ln -s /dev/null /etc/systemd/network/99-default.link

Отредактировать файл

/etc/network/interfaces, заменив или добавив туда новые именования:auto enp1s0f0 iface enp1s0f0 inet manual auto enp1s0f1 iface enp1s0f1 inet manual auto bond0 iface bond0 inet manual ... auto eth1 iface eth1 inet manual auto eth2 iface eth2 inet manual auto bond0 iface bond0 inet manual ...

Удалять или комментировать старые имена до следующей загрузки не требуется. При возникновении проблем, сервер применит сетевые настройки с ранее заданными именами.

На серверах виртуализации каждый VLAN подключается к сетевому мосту с соответствующим названием, указывающим на VLAN ID или роль, которую выполняет мост. Создание сетевых мостов на виртуальной машине Astra Cloud Installer не целесообразно.

Требования к подготовке программно-аппаратного окружения#

Примечание

Требования к программно-аппаратным ресурсам и конфигурации сети для развертывания сценария представлены в разделе Системные требования.

Дополнительные требования к подготовке программно-аппаратного окружения:

1 Для корректной автоматизации развертывания Платформы Astra Cloud требуется предварительно настроить следующие VLAN:

для установки ОС с использованием PXE;

сети управления IPMI;

управляющего трафиком (менеджмент сеть);

трафика СХД (в случае использования iSCSI);

трафика СРК.

Должна быть возможность использовать одинаковые последние октеты IP-адресов для всех серверов Платформы Astra Cloud во всех сетях. То есть для каждой локальной ВМ и ВМ под управлением ПК СВ должна быть возможность задать одинаковый последний октет для всех сетей.

Примечание

Для развертывания Платформы Astra Cloud выделено 3 сети:

192.168.22.0/24— менеджмент сеть:10.22.22.0/24— сеть СРК;10.205.17.0/24— сеть СХД.

В случае, если в Подсистеме развертывания и настройки или в файле с переменными для первого сервера управления ПК СВ будет задан адрес: 192.168.22.150, то, во время создания самой ВМ, ей будут добавлены все 3 сети и назначены адреса: 192.168.22.150, 10.22.22.150, 10.205.17.150.

В случае использовании iSCSI, для доступа к СХД, должны быть настроены 2 LUN (либо 3, в случае если для СРК RuBackup один из LUN дисков будет использоваться как внешнее хранилище), которые предоставляются через сеть, выделенную под трафик СХД. Эти 2 LUN будут использованы как СХД ПК СВ. Логические и физические размеры секторов на LUN должны совпадать, в ином случае использовать LUN как хранилища для BREST_LVM нельзя. Если возможности изменить размеры секторов нет, автоматизация установки Платформы Astra Cloud предоставляет код для подключения хранилищ типа LVM-LVM.

Минимальный размер iSCSI LUN или OSD дисков, который будет использоваться для хранилища данных ПК СВ без развертывания DCImanager, — 150 ГБ в случае iSCSI LUN (при использовании хранилища типа BREST_LVM, в ином случае минимальный размер — 370 ГБ), или 370 ГБ в случае OSD диска Ceph. В случае развертывания DCImanager, минимальный размер — 200 ГБ в случае iSCSI LUN (при использовании хранилища типа BREST_LVM, в ином случае минимальный размер — 570 ГБ), или 570 ГБ в случае OSD дисков Ceph. DCImanager является необязательным компонентом Платформы Astra Cloud и требует отдельного лицензирования.

Примечание

Такие размеры хранилища являются минимальными для возможности установки, в процессе эксплуатации количество занимаемого пространства будет увеличиваться.

В случае iSCSI LUN рекомендуется использовать хранилище типа BREST_LVM. Но в таком случае размер логических и физических блоков LUN дисков должен совпадать.

Минимальный размер iSCSI LUN или OSD дисков, который будет использоваться для хранилища образов ПК СВ — 50 ГБ в случае iSCSI LUN (при использовании хранилища типа BREST_LVM, в ином случае минимальный размер — 100 ГБ), или 100 ГБ в случае OSD диска Ceph.

Минимальный размер iSCSI LUN для хранения РК СРК RuBackup, создаваемых расписанием, — 50 ГБ.

7. Серверов ALD Pro может быть как 2, так и 3. Создание третьего сервера КД будет выполнено только в случае указания определенной переменной. Установочный сервер Платформы Astra Cloud (Astra Cloud Installer сервер) и три основных сервера виртуализации ПК СВ должны быть размещены в едином сегменте сети (без промежуточных маршрутизаторов), обеспечивая коммутацию трафика на уровне L2.

Примечание

Развертывание Платформы Astra Cloud версии 2.0 возможно двумя способами: устанавливая каждый компонент ОП в интерфейсе командной строки, используя предоставленные средства автоматизации развертывания (далее «автоматизация»), либо с использованием Подсистемы развертывания и настройки.

Создание установочного сервера Платформы Astra Cloud#

Установочный сервер Платформы Astra Cloud — это файл формата Qcow2.

Примечание

Для создания ВМ из файла, его необходимо расположить в директории, в которой хранятся образы libvirt (директория по умолчанию /var/lib/libvirt/images), поменять права файла на root:libvirt-qemu.

Поменять права можно выполнив команду:

sudo chown root:libvirt-qemu /var/lib/libvirt/images/<bootstrap_image_name>.qcow2

Далее в приложении Менеджер виртуальных машин создать новую ВМ, выбрав при ее создании пункт меню Импорт образа диска. Указав установочный Qcow2 образ как Выбор тома. В поле Выберите операционную систему для установки указать Debian 10.

Установочный образ содержит:

ОС Astra Linux Special Edition (далее — ALSE) версии 1.8.3 с оперативным обновлением UU2, уровень защищенности «Воронеж»;

PXE сервер (DHCP, TFTP, FTP);

Подсистему развертывания и настройки;

Необходимые для развертывания Платформы Astra Cloud приложения и директории;

В зависимости от сетевой топологии следует поменять настройки виртуальных сетевых интерфейсов, так как один используется для сетевой установки ОС на целевые серверы, а другой — для подключения к виртуальным машинам и целевым серверам.

Минимальные требования к ВМ сервера Astra Cloud Installer:

vCPU: 4 ядра;

RAM: 4 Gb;

HDD: от 150 Gb;

2 адаптера Ethernet (в ВМ Astra Cloud Installer сервера должно быть настроено минимум 2 подсети: подсеть для PXE, подсеть для управляющей сети — Менеджмент, по которой Подсистема развертывания и настройки будет разворачивать Платформу Astra Cloud на всех серверах);

Примечание

Имя пользователя и пароль Astra Cloud Installer сервера по умолчанию astra/astra.

К целевым серверам, которые будут являться клиентами PXE, должен быть добавлен сетевой интерфейс, подключенный к выделенному для PXE VLAN.

Порты этого VLAN предпочтительно подключать в режиме access. Рекомендуемая пропускная способность портов — не менее 1 Гбит/с.

Предупреждение

Нежелательно наличие работающих DHCP-серверов в этой сети, чтобы избежать сетевых проблем в ходе установки.

Подготовка Astra Cloud Installer сервера#

Перед началом развертывания Платформы Astra Cloud необходимо из личного кабинета загрузить на Astra Cloud Installer сервер ISO компонентов облачной платформы (далее — ОП), кроме ISO для DCImanager.

На Astra Cloud Installer сервере в домашней директории пользователя astra требуется организовать структуру папок. Для этого необходимо создать директорию с именем iso, полный путь до этой директории: /home/astra/iso. Она будет предназначена для хранения ISO компонентов ОП.

Примечание

Изначально директории уже существуют. Информация об их создании представлена на случай их удаления.

В ней необходимо создать следующие директории: aldpro_iso, alse_iso, billmanager_iso, brest_iso, rubackup_iso. Каждая директория предназначена для ISO и их хэш-сумм определенных компонентов Платформы Astra Cloud — ALD Pro, ALSE, BILLmanager, ПК СВ, RuBackup. Создать все эти директории можно командой:

mkdir -p /home/astra/iso/aldpro_iso /home/astra/iso/alse_iso /home/astra/iso/billmanager_iso /home/astra/iso/brest_iso /home/astra/iso/dci_manager_iso /home/astra/iso/rubackup_iso

Пример структуры каталогов и файлов внутри директории /home/astra/iso:

/home/astra/iso/

├── aldpro_iso

│ ├── ALDPro-3.0.0.gost

│ └── ALDPro-3.0.0.iso

├── alse_iso

│ ├── base-1.7.4.11-23.06.23_17.13.iso

│ ├── base-1.7.4.11-23.06.23_17.13.iso.gost

│ ├── installation-1.7.6.15-15.11.24_17.20.iso

│ ├── installation-1.7.6.15-15.11.24_17.20.iso.gost

│ ├── installation-1.8.3.8-21.08.25_15.43-di.iso

│ └── installation-1.8.3.8-21.08.25_15.43-di.iso.gost

├── billmanager_iso

│ ├── billmgr.aic.base.iso

│ ├── billmgr.aic.base.iso.gost

│ └── billmgr.aic.standard.iso

├── brest_iso

│ ├── brest-4.0.0-for-astra-1.8.3.uu1.iso

│ └── brest-4.0.0-for-astra-1.8.3.uu1.iso.gost

├── dci_manager_iso

│ ├── dci_latest.iso

│ └── dci6_repo.iso

└── rubackup_iso

├── rubackup-release_2.7.0.0.0.30_astra-1.7.iso

└── rubackup-release_2.7.0.0.0.30_astra-1.8.iso

Предупреждение

Файлы должны иметь именно такие имена, рядом с каждым ISO (кроме ISO для RuBackup, DCImanager и BILLmanager) должен быть расположен файл с его хэш-суммой.

В личном кабинете каждый образ имеет свое уникальное имя, включающее в себя версию продукта. При скачивании файлов из личного кабинета необходимо выбирать корректные версии файлов и сохранять их строго под теми же именами. Переименование файлов не допускается.

Примечание

DCImanager является необязательным компонентом Платформы Astra Cloud. В случае его установки, скачать нужные для него ISO (dci_latest.iso и dci6_repo.iso) можно на странице официальной документации. Репозиторий для ALSE 1.7.4.UU1 (base-1.7.4.11-23.06.23_17.13.iso) необходим только для DCImanager. Если в инсталляции ОП не планируется установка DCImanager — этот репозиторий и файл с его хэш-суммой не требуются.

После размещения ISO компонентов в соответствующие директории, требуется выполнить верификацию их хэш-сумм.

Проверка хэш-сумм#

Создание конфигурации#

Проверка хэш-сумм осуществляется через Подсистему развертывания и настройки. Для входа в Подсистему развертывания и настройки в браузере Firefox необходимо перейти по адресу установочного сервера Astra Cloud Platform, используя протокол https, порт 8443, добавив в конце /acp.

Пример URL:

https://192.168.22.21:8443/acp/

В открывшемся окне необходимо авторизоваться.

Примечание

Логин и пароль для входа по умолчанию: astra/astra.

Подсистема развертывания и настройки автоматически откроется на странице с конфигурациями:

Примечание

Конфигурация — зашифрованный файл, содержащий в себе все IP-адреса и переменные инсталляции Платформы Astra Cloud. Таким образом из одного установочного сервера возможна уcтановка ОП на несколько инфраструктур, с сохранением в отдельных сущностях всех параметров инсталляции.

Для начала работы с Подсистемой развертывания и настройки необходимо создать конфигурацию. Для этого:

В окне Конфигурация нажать на кнопку Создать.

В открывшемся окне Создание новой конфигурации задать имя и пароль новой конфигурации, нажать на кнопку Создать:

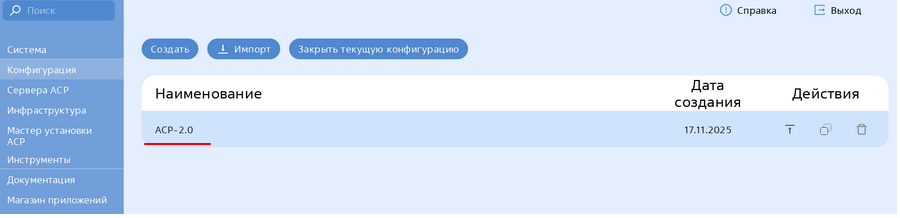

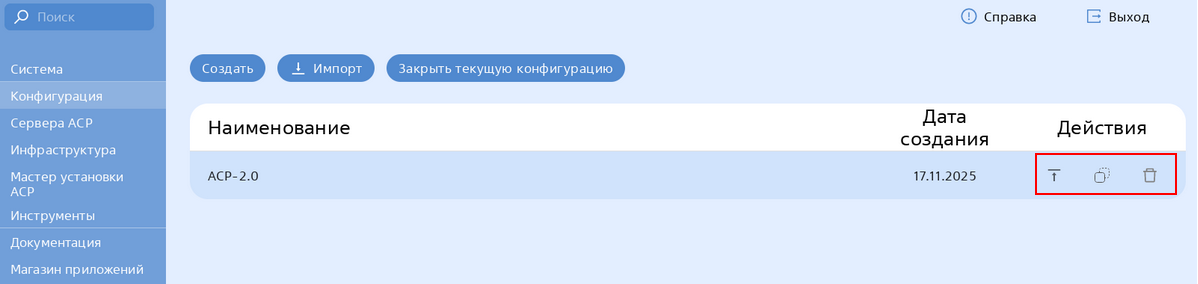

Новая конфигурация отобразится в списке доступных конфигураций.

Созданная конфигурация будет открыта автоматически.

Примечание

Для каждой конфигурации доступен ряд действий: экспорт, копирование и удаление. Кнопки действий расположены справа от даты создания конфигурации:

Таким образом при необходимости конфигурацию можно экспортировать как зашифрованный файл, сохранив все параметры инсталляции облачной платформы. Копирование конфигурации позволит сделать ее резервную копию, сохранив заполненную конфигурацию как эталонную для дальнейших изменений, в случае масштабирования ОП или смены карты сети.

При необходимости, конфигурацию в любой момент можно закрыть, сохранив внесенные в нее изменения. Но для ее повторного открытия потребуется ввести заданный при ее создании пароль.

Указание наличия DCImanager#

После создания конфигурации следует выбрать пункт основного меню слева Инфраструктура. В разделе Инфраструктура представлены все целевые серверы которые будут использоваться для инсталляции ОП, а также виртуальные машины, которые будут на них созданы в процессе инсталляции.

Так как DCImanager является опциональным компонентом ОП и в случае его установки будет провалидирована хэш-сумма ISO ОС СН ALSE 1.7.4 с оперативным обновлением UU1, на данном этапе, в зависимости от необходимости инсталляции DCImanager, следует добавить или удалить из инфраструктуры, предназначенный для него сервер.

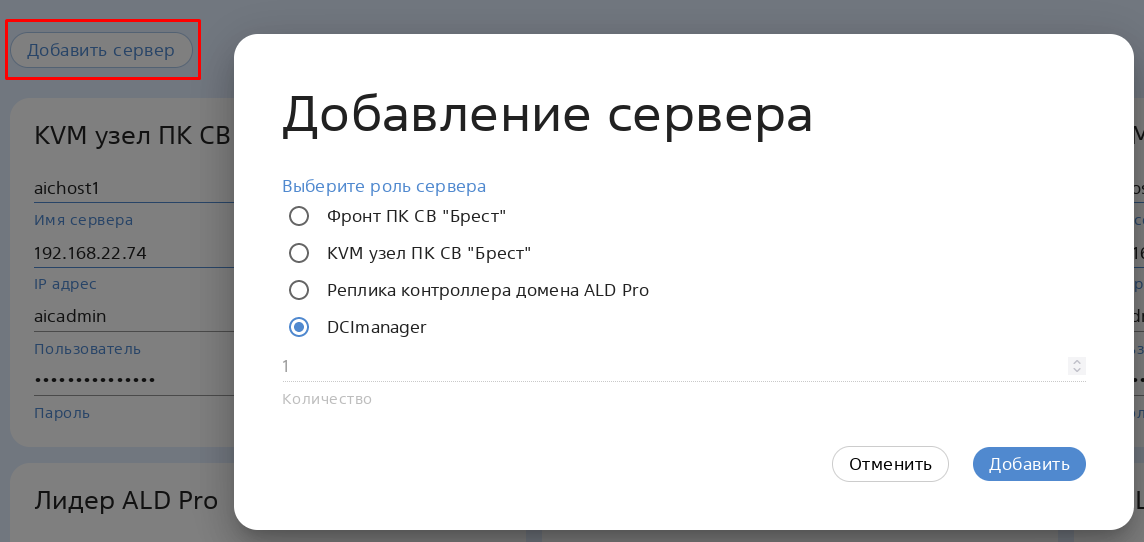

Для добавления сервера:

В окне Инфраструктура нажать на кнопку Добавить сервер.

В открывшемся окне Добавление сервера выбрать пункт DCImanager и нажать на кнопку Добавить:

Сервер DCImanager появится в перечне созданных серверов:

Если развертывание DCImanager не планируется в текущей инсталляции ОП, необходимо удостовериться, что данный сервер не присутствует в перечне созданных для инсталляции серверов. При его наличии, его следует удалить, нажав на символ крестика в правом верхнем углу карточки.

Запуск автоматизации проверки хэш-сумм#

Добавив или удалив сервер DCImanager из раздела Инфраструктура, необходимо:

Выбрать пункт основного меню слева Мастер установки ACP и в открывшемся окне нажать на кнопку Запустить мастер Установки.

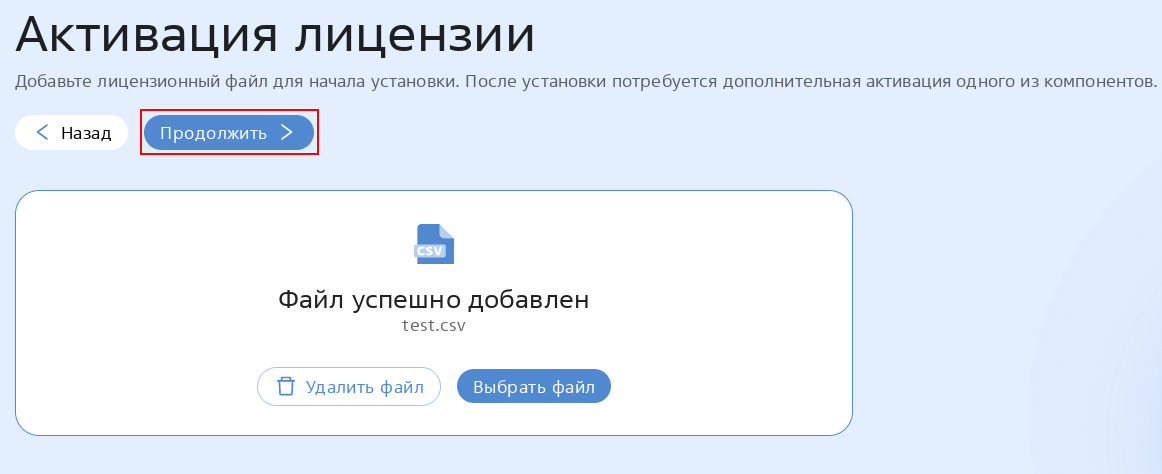

2. Платформы Astra Cloud (ОП) выпускается в 2-х редакциях: Базовой (Base) и Стандартной (Standart). Подсистема развертывания и настройки автоматически предложит выбрать редакцию для установки, соответствующую редакции скаченного из личного кабинета установочного сервера. После добавления или удаления сервера DCImanager откроется окно Активация лицензии.

Предупреждение

Данный этап является ознакомительным, так как в дальнейшем лицензирование ОП будет осуществляться через Подсистему развертывания и настройки.

Файл с лицензией по умолчанию уже добавлен. Удаление или замена данного файла не допускается.

В открывшемся окне Активация лицензии нажать на кнопку Продолжить:

Далее откроются окна Ресурсы: сетевые, локальные, ПК СВ Брест и Ключевые компоненты, так как на данном этапе необходимо выполнить только проверку хэш-сумм ISO, их необходимо пропустить, нажав на кнопку Продолжить в каждом из них.

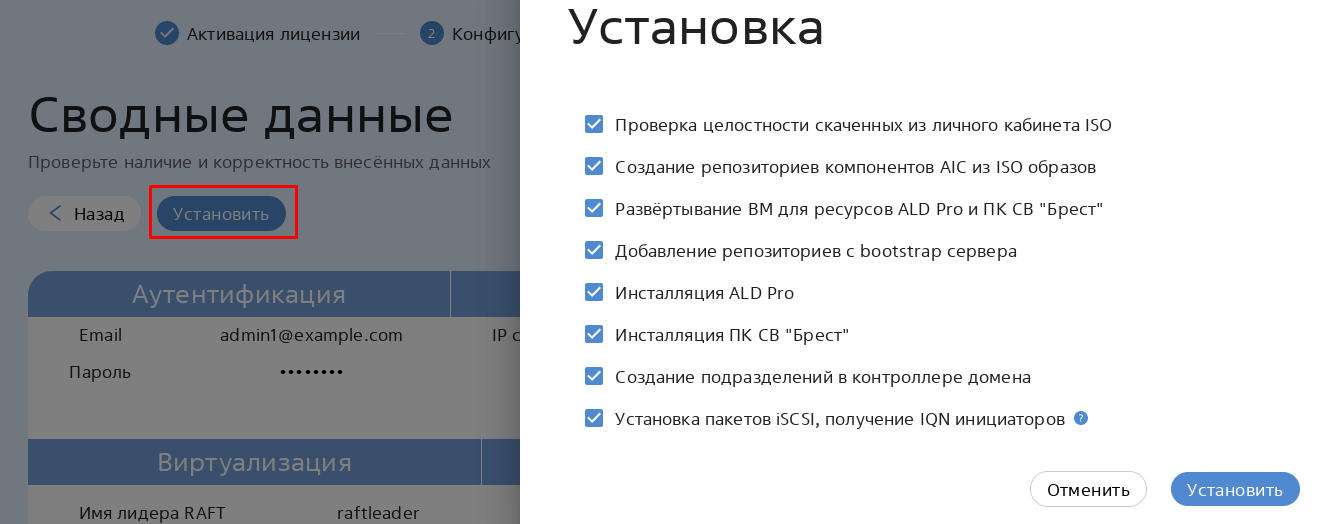

После этого откроется окно Сводные данные с информацией о параметрах инсталляции ОП. Так как подразделы для их заполнения были пропущены, представленные в сводной таблице данные будут шаблонными.

На данном этапе необходимо нажать на кнопку Установить, после чего будет открыто окно с этапами инсталляции:

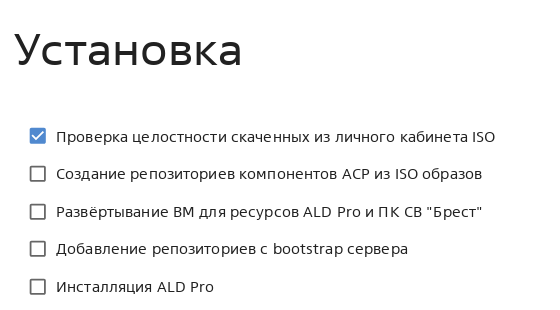

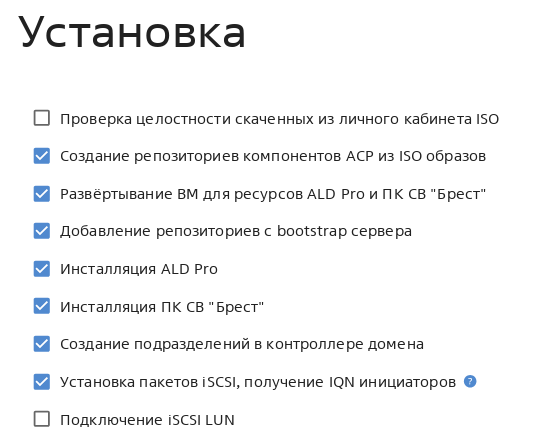

В открывшемся окне Установка необходимо:

Оставить выбранным только самый первый этап — Проверка целостности скаченных из личного кабинета ISO.

Нажать на кнопку Установить.

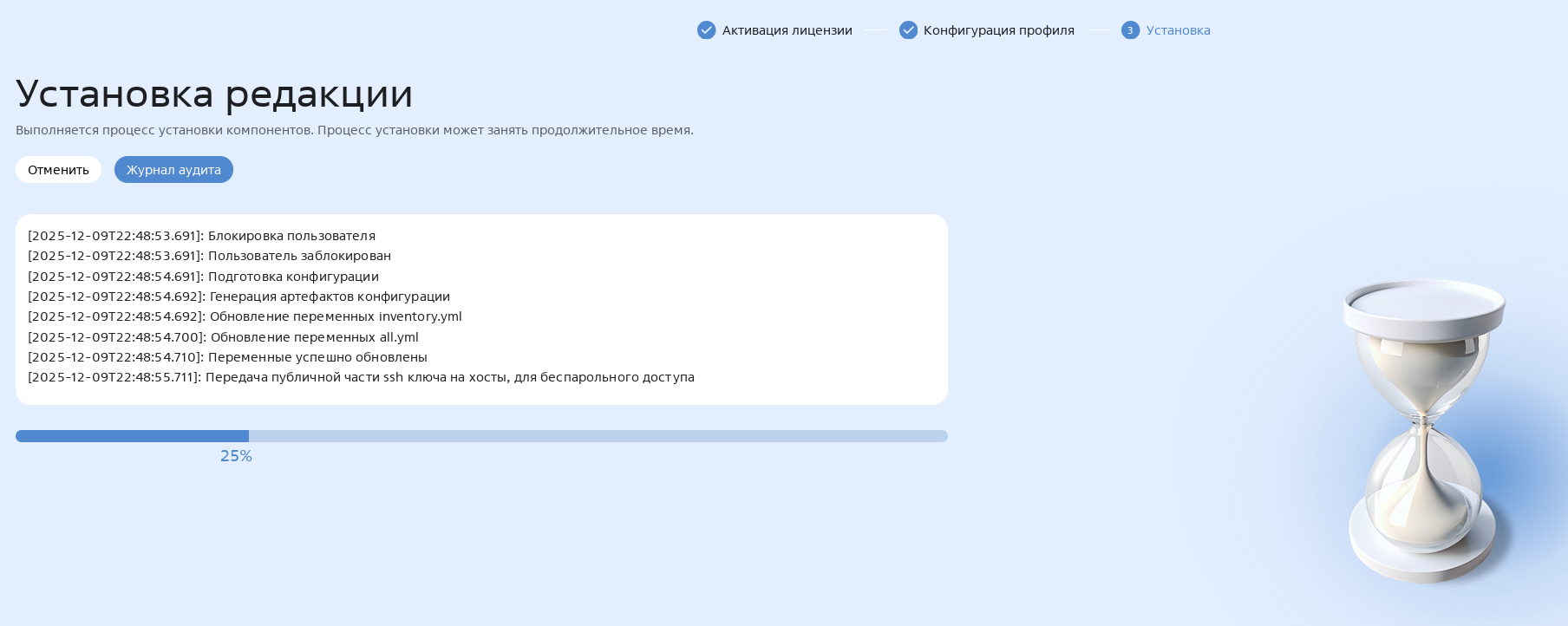

После этого откроется страницы с журналом, отображающим процесс выполнения автоматизации:

После выполнения проверки хэш-сумм Подсистема развертывания и настройки откроет страницу успеха:

На данном этапе проверка хэш-сумм ISO будет завершена. Далее необходимо перейти к установке ОС на целевые серверы.

Установка ОС на целевые серверы#

На целевые серверы, предназначенные для инсталляции Astra Cloud Platform, необходимо установить ОС СН ALSE 1.8.3.UU1.

Установка ОС выполняется вручную администратором платформы. Установочный образ ОС нужно взять с установочного сервера Платформы Astra Cloud, предварительно удостоверившись, что его хэш-сумма совпадает с хэш-суммой, указанной в файле .gost на предыдущем этапе.

Предупреждение

В Astra Cloud Platform есть разделение целевых серверов на 2 группы: целевые серверы, на которых будут размещены служебные ВМ самой ОП, и целевые серверы, предназначенные для клиентских нагрузок (серверы виртуализации ПК СВ «Брест»).

При этом количество планируемых для развертывания серверов управления ПК СВ «Брест» или серверов контроллера домена ALD Pro не должно быть меньше, чем количество целевых серверов, предназначенных для служебных ВМ ОП.

Используемая в инструкции конфигурация ОП не учитывает серверы виртуализации ПК СВ «Брест», предназначенные для клиентских нагрузок.

Установить ОС необходимо на все целевые серверы, которые будут использоваться для инсталляции ОП, независимо от их роли.

После загрузки с установочного ISO-образа, откроется меню с выбором вариантов установки. Рекомендуется выбрать пункт Графическая установка:

Примечание

В случае выбора пункта Установка необходимо задать параметры ОС, аналогичные описанным в текущем разделе инструкции для графической установки.

Далее в открывшемся окне с условиями Лицензионного соглашения следует перейти в конец документа и выбрать значение Да в поле Принимаете ли Вы условия настоящей лицензии. После этого начнется процесс установки:

В открывшемся окне Настройка клавиатуры выбор способа переключение между национальной и латинской раскладкой не важен. После завершения автоматической загрузки основных компонентов и определения сетевой карты выполнится автоматическая настройка сети. Установщик получит IP-адрес через протокол DHCP.

Предупреждение

Если в сети нет DHCP-сервера, а среда установки ОП не имеет выход в интернет, то получение IP-адреса завершиться с ошибкой:

В таком случае следует нажать на кнопку Продолжить и в открывшемся меню с методами настройки сети выбрать пункт Настроить сеть вручную.

В открывшемся окне задать IP-адрес, который получит сервер после инсталляции, затем задать маску подсети и шлюз.

Примечание

Назначенный IP-адрес должен быть из сети, подключенной к целевому серверу.

После указание шлюза откроется окно для ввода адреса DNS-серверов. Так как в процессе инсталляции облачной платформы будет развернута Подсистема идентификации и аутентификации (компонент контроллера домена ALD Pro), которая будет выступать в качестве корневого DNS-сервера, задавать DNS-сервер в процессе инсталляции ОС не требуется. Поле для ввода необходимо оставить пустым.

Примечание

В случае наличия в инфраструктуре внешнего DNS-сервера, его необходимо добавить в ALD Pro. Если задать его в процессе установки, записи о нем на сервере будут переписаны контроллером домена.

Далее необходимо задать имя сервера.

Примечание

Имя сервера должно быть длиной от 1 до 15 символов. Допускается использование латинских букв, цифр, дефиса и подчеркивания. Имя не должно начинаться или оканчиваться на дефис, не должно быть «зарезервированным словом» (например,

localhost,null) и не должно совпадать с именами уже существующих серверов в сети.Следующее окно — окно для указания имени домена.

Предупреждение

Сервер будет введен в домен во время инсталляции ALD Pro, на текущем этапе поле необходимо оставить пустым.

Далее выполняется настройка учетных записей пользователей и паролей:

В окне Имя учетной записи администратора задать имя администратора. Требования к имени учетной записи администратора аналогичны требованиям к имени сервера.

В окне для ввода пароля задать пароль учетной записи администратора.

После указание учетных данных администратора необходимо выбрать часовой пояс.

Следующий этап установки — Разметка дисков:

В зависимости от необходимости настройки LVM следует выбрать один из представленный в меню вариантов. Если настройка LVM не планируется, необходимо выбрать пункт Авто — использовать весь диск, затем выбрать диск, на которой будет установлена ОС.

Далее следует указать схему разметки диска. Выбор схемы разметки не влияет на инсталляцию ОП.

После выбора схемы разметки откроется окно с выбранными ранее параметрами разметки дисков. При необходимости можно вернуться на предыдущие этапы, либо настроить RAID.

Удостоверившись в корректности информации, представленной в сводной таблице, выбрать пункт Закончить разметку и записать изменения на диск, и дополнительно подтвердить внесение изменения на диск.

На этом сбор предварительной информации будет завершен, запустится процесс установки ОС.

Процесс установки ОС состоит из следующих этапов:

Выбор ядра. Установщик предложит выбрать ядро для установки:

linux-6.1-genericлибо linux-6.12-generic.Предупреждение

Для корректной работы ПК СВ 4.0.0 строго необходимо выбрать ядро

linux-6.1-generic.Выбор программного обеспечения. После установки ядра

linux-6.1-genericоткроется окно Выбор программного обеспечения. В данном окне следует отметить только 3 пункта из списка: Графический интерфейс Fly, Средства Виртуализации и Средства удаленного подключения SSH:

Выбор уровня защищенности. Необходимо выбрать Максимальный уровень защищенности «Смоленск».

Предупреждение

В случае выбора другого уровня защищенности, инсталляция ОП будет невозможна без повышения уровня вручную.

Выбор дополнительных параметров безопасности ОС. В открывшемся окне Дополнительные настройки ОС следует отметить только 2 пункта из списка: Мандатный контроль целостности и Мандатное управление доступом, нажать на кнопку Продолжить:

Принятие решение по установке системного загрузчика GRAB на первичный диск. Данный вариант является рекомендованным и задан по умолчанию. Для установки GRUB на первичный диск, на данном этапе нажать на кнопку Продолжить, оставив окно без изменений.

Установка пароля для GRUB.

Это меню будет являться последним необходимым для инсталляции.

В окне Завершение установки нажать на кнопку Продолжить, после чего будет выполнен системный постустановочный скрипт, по завершению которого ОС будет установлена, а сервер перезагружен.

Примечание

Таким образом нужно установить ОС на все целевые серверы, используемые в инсталляции Облачной платформы.

Действия после установки ОС#

После установки ОС на серверы, перед запуском процесса развертывания платформы, необходимо выполнить следующие действия:

Настроить сетевые интерфейсы на целевых серверах, в соответствии с утвержденной сетевой топологией, если эта настройка не была выполнена ранее. Для этого добавить сетевые мосты для трех сетей (Менеджмент сеть, сеть для трафика СРК, сеть для трафика СХД) на каждом из целевых серверов. Сетевой мост для сети СХД нужен только в случае если в качестве СХД будет использован iSCSI, либо иной вариант СХД, требующий выделенную сеть. Сетевые мосты должны иметь одинаковые имена на всех серверах. Например, если мост Менеджмент сети на первом сервере называется

br200, то на втором и на третьем серверах он должен называться так же.Пример готовой конфигурации сети в файле

/etc/network/interfaces:source /etc/network/interfaces.d/* # --- networks in use: # vlan 200 - management : 192.168.22.0/24 # vlan 170 - iSCSI : 10.205.17.0/24 # vlan 169 - backup : 10.22.222.0/24 # ------------------------------------------------------------- auto lo iface lo inet loopback # bond0 lacp auto eno1 iface eno1 inet manual auto eno2 iface eno2 inet manual auto bond0 iface bond0 inet manual mtu 9000 bond-slaves eno1 eno2 bond-mode 802.3ad bond-miimon 100 bond-lacp-rate fast bond-xmit-hash-policy layer3+4 bond-updelay 200 bond-downdelay 200 # ------------------------------------------------------------- # vlan 200 - mgmt auto bond0.200 iface bond0.200 inet manual vlan-raw-device bond0 auto br200 iface br200 inet static mtu 9000 address 192.168.22.74/24 # address 192.168.22.75/24 # address 192.168.22.76/24 bridge_ports bond0.200 bridge_stp on # ------------------------------------------------------------- # vlan 170 - iSCSI auto bond0.170 iface bond0.170 inet manual vlan-raw-device bond0 auto br170 iface br170 inet static mtu 9000 address 10.205.17.14/24 # address 10.205.17.15/24 # address 10.205.17.16/24 bridge_ports bond0.170 bridge_stp on # ------------------------------------------------------------- # vlan 169 - backup auto bond0.169 iface bond0.169 inet manual vlan-raw-device bond0 auto br169 iface br169 inet static address 10.22.22.14/24 # address 10.22.22.15/24 # address 10.22.22.16/24 bridge_ports bond0.169 bridge_stp on

Представленный пример конфигурационного файла подходит для трех серверов, на каждом из которых нужно раскомментировать соответствующую строку с нужным адресом. В примере каждый VLAN подключается через агрегированные каналы связи (bonding) для повышения пропускной способности и надежности. Это не является обязательным условием. Настройка сетевой части должна осуществляться для каждой инфраструктуры индивидуально, учитывая ее особенности.

Обеспечить беспарольный доступ по SSH до целевых серверов. Для этого:

На установочном сервере ОП сгенерировать ключи командой:

ssh-keygen

Нажатием клавиши <Enter>, принять все установленные по умолчанию значения, предлагаемые для генерации SSH-ключа.

Разместить ключи на каждом целевом сервере командой:

ssh-copy-id <login>@<IP>

После ввода пароля от указанного в команде пользователя беспарольный доступ по SSH будет обеспечен.

Примечание

Обе команды необходимо запускать от имени пользователя

astra.В файле

/etc/hostsна Astra Cloud Installer сервере добавить записи обо всех целевых серверах и серверах виртуализации, которые предназначены для ресурсов компонентов ПК СВ и ALD Pro. Записи должны включать в себя FQDN (это доменное имя будет использоваться при развертывании ОП).Пример записей о целевых серверах:

/etc/hosts 192.168.22.74 aichost1.aicstand.ru aichost1 192.168.22.75 aichost2.aicstand.ru aichost2 192.168.22.76 aichost2.aicstand.ru aichost3 192.168.22.233 node1-test.aicstand.ru node1-test 192.168.22.234 node2-test.aicstand.ru node2-test 192.168.22.235 node3-test.aicstand.ru node3-test 192.168.22.230 dc1-test.aicstand.ru dc1-test 192.168.22.231 dc2-test.aicstand.ru dc2-test 192.168.22.240 rubackup-server.aicstand.ru rubackup-server 192.168.22.241 monitoring.aicstand.ru monitoring 192.168.22.242 bill-manager.aicstand.ru bill-manager 192.168.22.243 dci-manager.aicstand.ru dci-manager 192.168.22.245 marketplace.aicstand.ru marketplace

Пример сетевой конфигурации, используемой в данной инструкции#

Основные 3 сети:

192.168.22.0/24 — Менеджмент сеть, создан сетевой мост br200;

10.22.22.0/24 — Сеть СРК, создан сетевой мост br169;

10.205.17.0/24 — Сеть СХД, создан сетевой мост br170.

Адреса, присвоенные целевым серверам:

192.168.22.74;

192.168.22.75;

192.168.22.76.

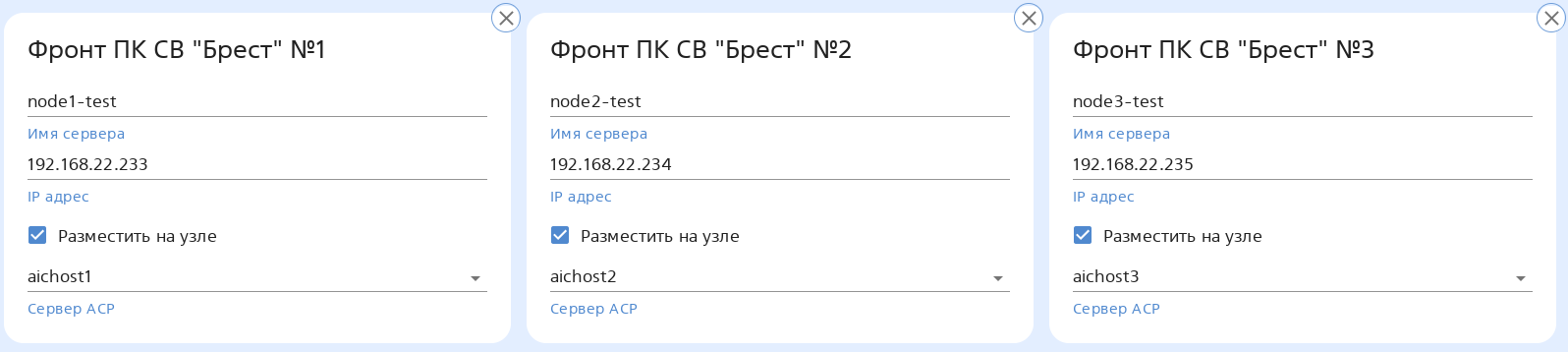

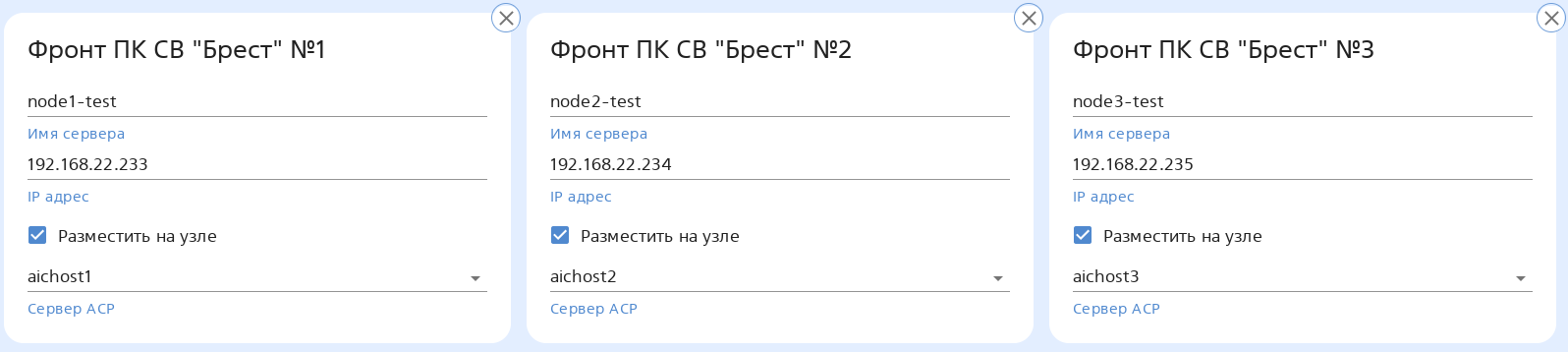

Адреса, присвоенные серверам управления ПК СВ:

192.168.22.233;

192.168.22.234;

192.168.22.235.

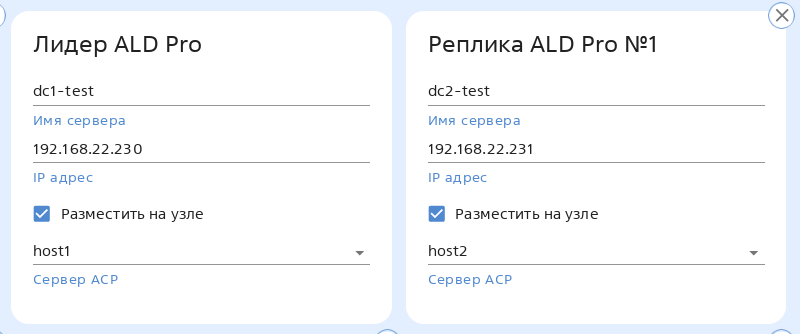

Адреса, присвоенные серверам Контроллера Домена:

192.168.22.230;

192.168.22.231.

Адрес портала iSCSI:

10.205.17.90.

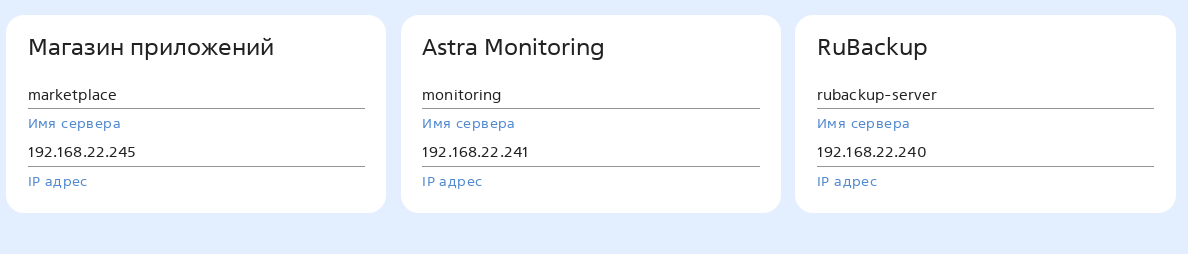

Адреса ВМ под управлением ПК СВ:

192.168.22.240 — СРК RuBackup;

192.168.22.241 — Astra Monitoring;

192.168.22.242 — BILLmanager;

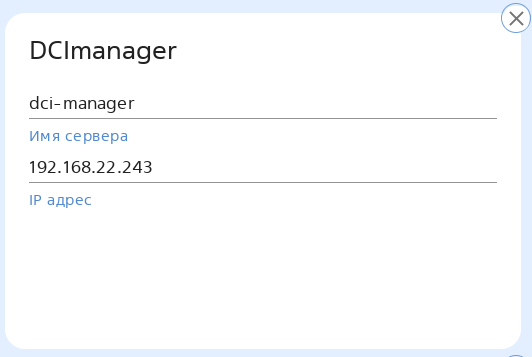

192.168.22.243 — DCImanager;

192.168.22.245 — Marketplace.

Целевые серверы имеют выход во все три сети и оснащены сетевыми мостами для виртуальных машин. Виртуальные машины, представляющие сервер управления ПК СВ, подключены ко всем трем сетям. Виртуальные машины, работающие как серверы контроллера домена, имеют доступ к сети управления и сети СРК. Виртуальные машины под управлением ПК СВ оснащены двумя сетевыми интерфейсами, предоставляющими доступ к сети управления и сети СРК.

Серверы Платформы Astra Cloud#

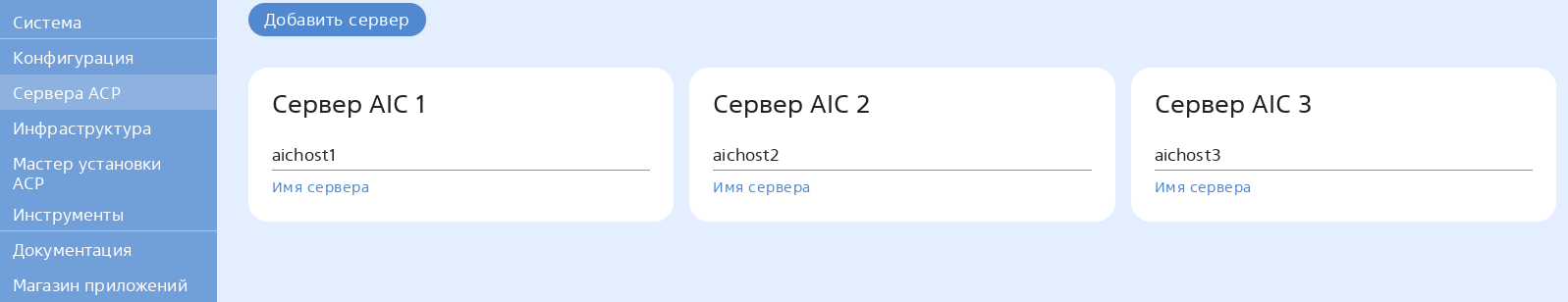

После установки ОС на целевые серверы следует перейти к конфигурированию серверов ОП. Для этого:

В меню слева выбрать пункт Серверы ACP.

В открывшемся окне Серверы ACP указать имена всех целевых серверов, которые будут заданы в процессе установки ОС.

Примечание

Заданное на данном этапе имя каждого из серверов должно совпадать с

hostname, указанным в процессе установки ОС.Для корректного развертывания Платформы Astra Cloud необходимо использовать минимум три целевых сервера.

Добавление серверов производится кнопкой Добавить сервер в верхней части окна Серверы ACP. Каждое нажатие добавит еще один сервер в общий перечень.

Развертывание инфраструктуры Платформы Astra Cloud#

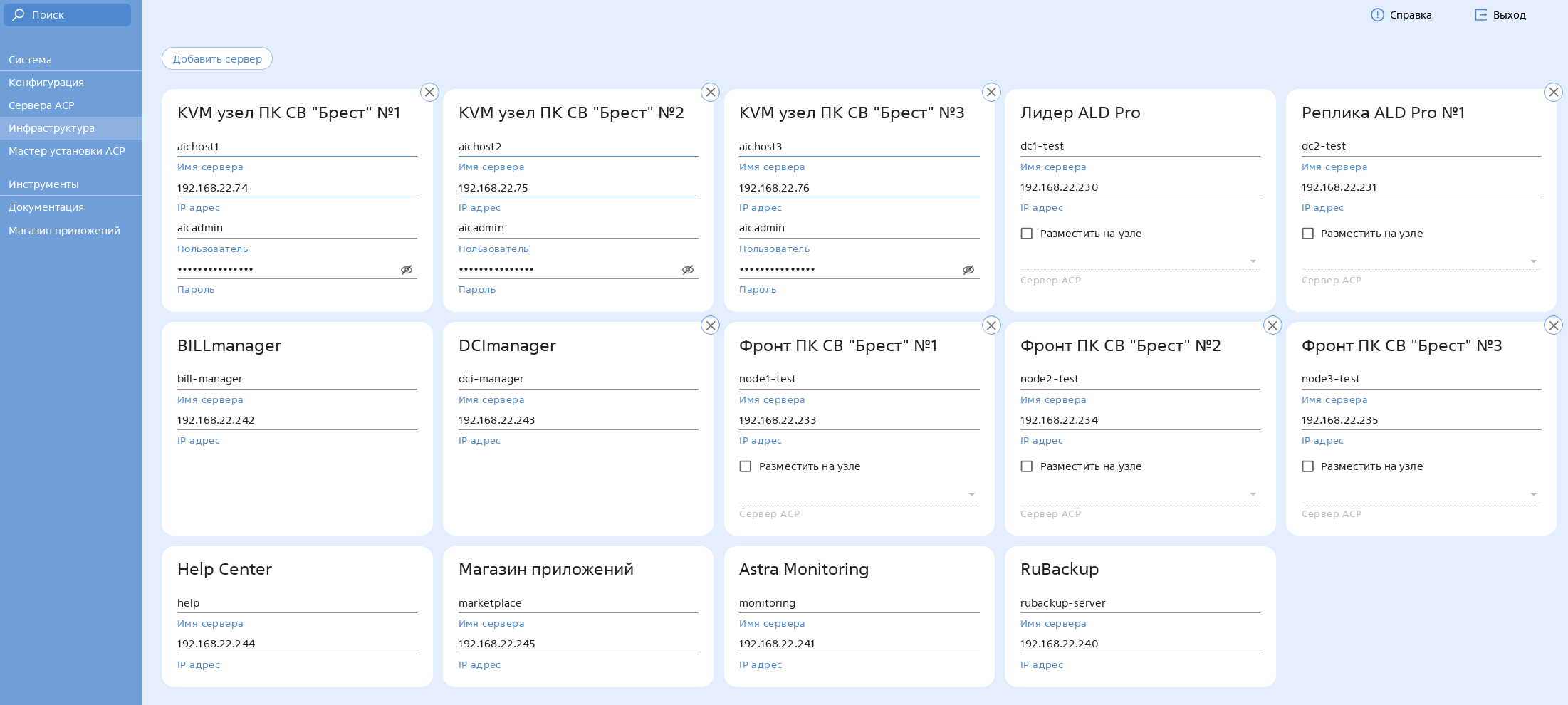

По завершении установки ОС необходимо перейти к конфигурированию инфраструктуры ОП. Для этого выбрать пункт Инфраструктура основного меню слева.

В разделе Инфраструктура представлены все целевые серверы, которые будут использоваться для инсталляции ОП, а также виртуальные машины, которые будут на них созданы в процессе инсталляции.

Раздел можно поделить на 3 логические группы:

Целевые серверы.

Локальные виртуальные машины на целевых серверах (серверы управления ПК СВ, серверы контроллера домена ALD Pro).

Виртуальные машины под управлением ПК СВ (подсистема тарификации BILLmanager, СРК RuBackup, подсистема мониторинга Astra Monitoring, Магазин приложений, DCImanager).

Каждый целевой сервер, сервер управления ПК СВ, сервер контроллера домена и компонент Платформы Astra Cloud представлен в своей отдельной карточке:

Примечание

Все IP-адреса, указываемые в разделе Инфраструктура должны быть в Менеджмент сети.

На данном этапе необходимо выполнить следующие действия:

Для подготовки трех целевых серверов, в каждый из трех блоков KVM узел ПК СВ «Брест»:

В поле Имя сервера ввести имя одного из трех ранее подготовленных серверов виртуализации, на которых будут создаваться ВМ для контроллера домена и серверов управления.

В поле IP-адрес указать IP-адрес соответствующего сервера виртуализации.

В поле Пользователь указать имя Сервисного пользователя с административными правами;

В поле Пароль задать пароль указанного пользователя:

Примечание

Имена серверов и их количество, указанные в текущем разделе, должны совпадать с именами и количеством, указанными в разделе Серверы ACP.

Серверы управления ПК СВ и серверы контроллера домена будут размещены в виртуальных машинах на данных целевых серверах, сами виртуальные машины будут созданы в процессе инсталляции ОП.

В блоках Лидер ALD Pro и Реплика ALD Pro №1:

В поле Имя сервера указать имена серверов КД ALD Pro (основного и реплики).

Примечание

Имена серверов не должны содержать в себе спецсимволы кроме

-.В поле IP-адрес указать IP-адреса серверов КД ALD Pro (основного и реплики).

Примечание

Несмотря на разделение серверов КД на лидера и реплику, они являются равноправными. Между ними будет настроена двунаправленная репликация с периодичностью синхронизации баз данных примерно раз в 5-10 минут. Такое разделение представлено исключительно для удобства работы автоматизации.

В поле Разместить на KVM узле установить флаг.

Примечание

Серверы Контроллера Домена могут быть развернуты на отдельных серверах или на виртуальных машинах (рекомендуется развертывать как ВМ). От установки флага в поле Разместить на KVM узле зависит, будут ли ВМ для КД (Лидер ALD Pro и Реплика ALD Pro) развернуты на физических серверах ОП. При выборе данной опции каждый контроллер домена будет размещен и настроен на своем физическом сервере автоматически. Если опция будет отключена, пользователю потребуется самостоятельно подготавливать серверы для данных ролей.

При развертывании КД на целевых серверах необходимо снять данный флаг, предварительно подготовив серверы, обеспечив беспарольный доступ Сервисному пользователю, заданному в блоке KVM узел ПК СВ «Брест».

В выпадающем списке поля Сервер ACP выбрать сервер, на котором следует разместить ВМ:

Примечание

Для удобства, рекомендуется разместить первый сервер КД и первый сервер управления ПК СВ на первом целевом сервере, второй сервер КД и второй сервер управления ПК СВ на втором целевом сервере и т.д.

Во всех трех блоках Фронт ПК СВ «Брест»:

В поле Имя сервера указать имя каждого из трех серверов управления ПК СВ «Брест».

В поле IP-адрес указать IP-адреса соответствующих серверов управления.

В поле Разместить на KVM узле установить флаг.

Примечание

Серверы управления ПК СВ могут быть развернуты на отдельных серверах или на виртуальных машинах (рекомендуется развертывать как ВМ). От установки флага в поле Разместить на KVM узле зависит, будут ли ВМ для серверов управления ПК СВ (Фронты ПК СВ «Брест») развернуты на физических серверах Платформы Astra Cloud. При выборе данной опции каждый сервер управления ПК СВ будет размещен и настроен на своем физическом сервере автоматически. Если опция будет отключена, пользователю потребуется самостоятельно подготавливать серверы для данных ролей.

При развертывании серверов управления ПК СВ на физических серверах необходимо снять данный флаг, предварительно подготовив серверы, обеспечив беспарольный доступ Сервисному пользователю, заданному в блоке KVM узел ПК СВ «Брест».

В выпадающем списке поля Сервер ACP выбрать целевой сервер, на котором следует разместить ВМ.

Примечание

Для удобства, рекомендуется разместить первый сервер КД и первый сервер управления ПК СВ на первом целевом сервере, второй сервер КД и второй сервер управления ПК СВ на втором целевом сервере и т.д.

Предупреждение

При необходимости, количество серверов управления может быть увеличено. Для добавления дополнительных серверов управления в окне Инфраструктура необходимо нажать на кнопку Добавить сервер. Допустимое количество серверов управления ПК СВ — 3, 5, 7. Использовать другое количество серверов не допускается. Ограничения обусловлены наличием механизма отказоустойчивости RAFT, рассчитанного на нечетное количество серверов (от 3-х). Кроме того, использование более 7 серверов управления ПК СВ значительно снижает скорость его работы. На одном целевом сервере может быть размещено по одному серверу управления и одному серверу контроллера домена.

Перед переходом к виртуальным машинам под управлением ПК СВ «Брест» убедиться, что выполнены требования к минимальному количеству обоих типов ВМ.

В блоках BILLManager, DCImanager, Магазин приложений, Astra Monitoring и RuBackup:

В поле Имя сервера задать имя, которое получит ВМ каждого из компонентов после создания.

В поле IP-адрес каждого из компонентов Платформы Astra Cloud указать IP-адрес ВМ в Менеджмент сети:

Предупреждение

Имена серверов для данных компонентов должны начинаться со строчной буквы латинского алфавита.

Запуск процесса установки#

Примечание

Перед запуском процесса установки следует удостовериться, что все параметры инфраструктуры сконфигурированы, а на серверы установлена базовая ОС.

По завершении конфигурирования инфраструктуры Платформы Astra Cloud, следует перейти в раздел установки ОП, выбрав пункт основного меню слева Мастер установки ACP и в открывшемся окне нажать на кнопку Запустить мастер установки:

Платформа Astra Cloud поставляется в двух редакциях: Base (Базовая) и Standard (Стандартная). Для перехода к процессу развертывания, в открывшемся окне с вариантами установки необходимо выбрать из предложенных редакцию, соответствующую приобретенной лицензии. Нажать на кнопку: Установить Base либо Установить Standard соответственно.

Процесс установки состоит из нескольких этапов:

Активация лицензии#

Приобретенная лицензия будет подгружена в систему автоматически. Для продолжения развертывания следует нажать на кнопку Продолжить, оставив окно без изменений:

Конфигурация профиля#

На данном этапе производится конфигурирование профиля, сети, хранилища и ключевых компонентов Платформы Astra Cloud. Для этого:

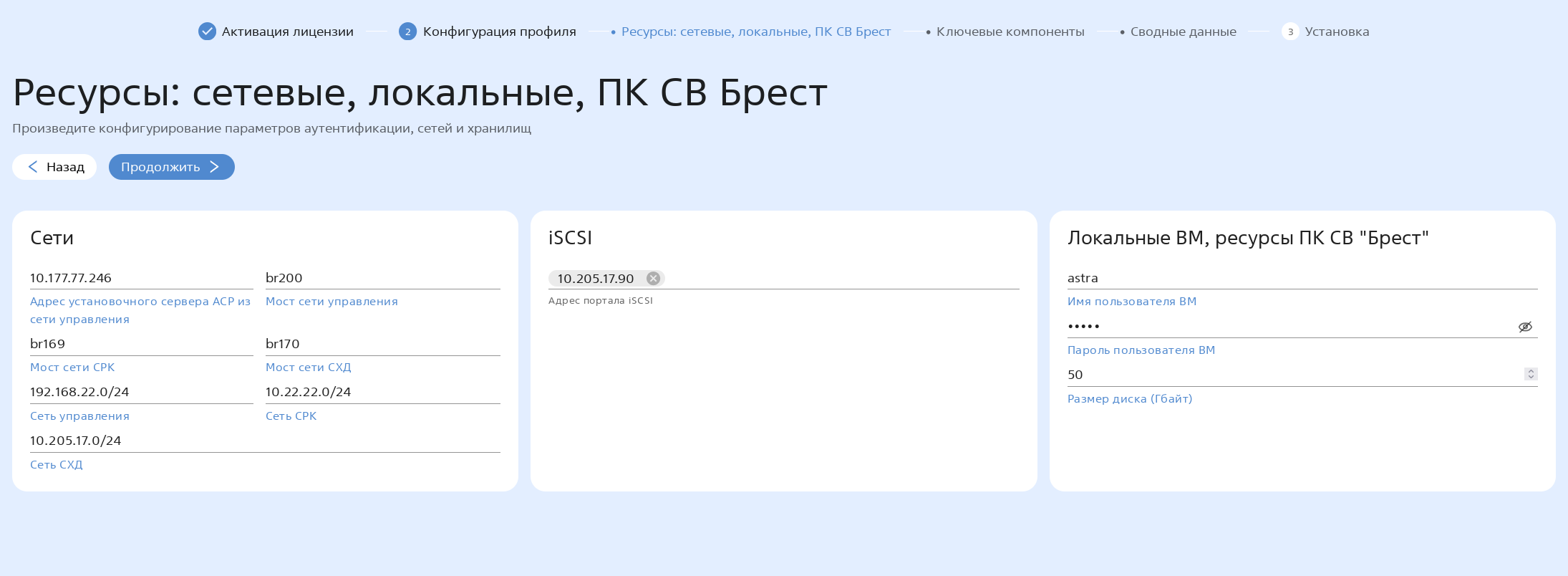

В открывшемся окне Ресурсы: сетевые, локальные, ПК СВ Брест:

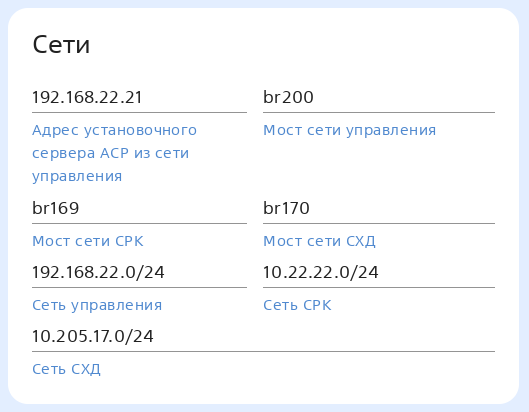

В блоке Сети указать сетевые параметры, в соответствии с выделенными для инсталляции ОП сетями:

в поле Адрес установочного сервера ОП из сети управления указать IP-адрес Astra Cloud Installer сервера из Менеджмент сети. На данном сервере будут созданы репозитории из скаченных ранее ISO. Этот адрес будет использоваться в ссылке репозиториев;

в поле Мост сети управления указать имя сетевого моста на целевых серверах, который имеет выход в Менеджмент сеть. Сетевой мост должен быть предварительно создан на всех целевых серверах, которые будут использоваться для инсталляции ОП. На основе этого сетевого моста будет создана виртуальная сеть, подключенная к локальным ВМ;

в поле Мост сети СРК указать имя сетевого моста на целевых серверах, который имеет выход в сеть для трафика СРК. Сетевой мост должен быть предварительно создан на всех целевых серверах, которые будут использоваться для инсталляции ОП. На основе этого сетевого моста будет создана виртуальная сеть, подключенная к локальным ВМ;

в поле Мост сети СХД указать имя сетевого моста на целевых серверах, который имеет выход в сеть для трафика СХД. Сетевой мост должен быть предварительно создан на всех целевых серверах, которые будут использоваться для инсталляции ОП. На основе этого сетевого моста будет создана виртуальная сеть, подключенная к локальным ВМ. Переменная необходима в случае, если в качестве хранилище для ПК СВ будет использовать iSCSI, или иной тип СХД, требующий отдельную сеть;

в поле Сеть управления указать адрес сети, выделенной для сети управления (Менеджмент сети). Данная сеть должна присутствовать на всех целевых серверах, которые будут использоваться для инсталляции ОП.Значение должно быть указано в формате адрес/маска;

в поле Сеть СРК указать адрес сети, выделенной для трафика СРК RuBackup. Данная сеть должна присутствовать на всех целевых серверах, которые будут использоваться для инсталляции ОП. Значение должно быть указано в формате адрес/маска;

в поле Сеть СХД указать адрес сети, имеющий выход во внешнее хранилище, например, портал iSCSI, по которому будут доступны LUN диски. Данная сеть должна присутствовать на всех целевых серверах, которые будут использоваться для инсталляции ОП, в случае, если в качестве хранилище для ПК СВ будет использовать iSCSI, или иной тип СХД, требующий отдельную сеть. Значение должно быть указано в формате адрес/маска.

Предупреждение

Для корректной установки Платформы Astra Cloud требуется предварительно создать на серверах виртуализации Мост сети управления и Мост сети СРК. В противном случае установка выполнена не будет.

Поля Мост сети СХД и Сеть СХД не являются обязательными к заполнению. В случае незаполнения данных полей, виртуальная сеть для СХД не будет создана и не будет подключена к серверам виртуализации и управления ПК СВ «Брест».

Сетевые мосты, относящиеся к одной сети, должны иметь одинаковые имена на всех серверах. Например, если мост менеджмент сети на первом сервере называется br200, то на втором и на третьем серверах он должен называться так же.

В процессе создания локальных ВМ будет выполнен ряд проверок на валидность значений переменных, а также на наличие сетевых мостов на серверах Платформы Astra Cloud. В случае если автоматизация завершится с ошибкой, в Журнале установки появится информация с описанием причин ее возникновения.

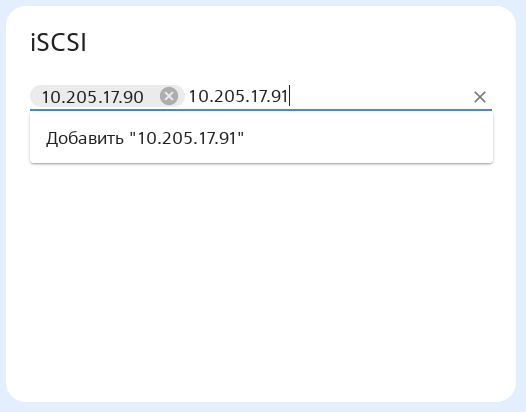

В блоке iSCSI указать адрес портала, который предоставляет минимум 2 iSCSI LUN. Адрес портала должен быть из сети СХД.

В случае, если в качестве СХД для ПК СВ планируется использовать не iSCSI, а другой тип хранилища, поле можно оставить пустым, либо использовать значение по умолчанию.

Если каждый из необходимых LUN дисков расположен на отдельных порталах, после указание первого портала следует указать следующий, нажав на кнопку Добавить после ввода адреса:

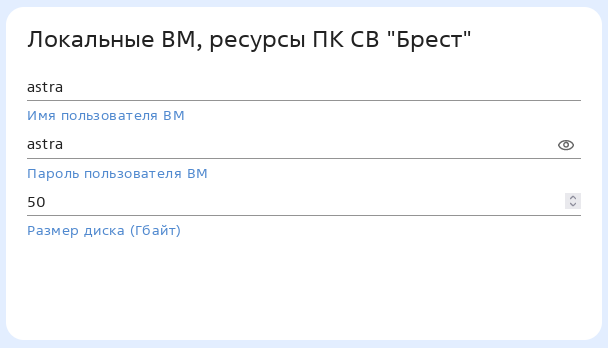

В блоке Локальные ВМ, ресурсы ПК СВ «Брест» задать параметры для всех ВМ, которые будут созданы в процессе инсталляции Платформы Astra Cloud:

в полях Имя пользователя ВМ и Пароль пользователя ВМ указать учетные данные Сервисного пользователя. Все ВМ в инсталляции ОП будут иметь пользователя с таким именем. От имени этого пользователя будет выполняться установка и настройка всех компонентов ОП.

в поле Размер диска (ГБ) указать в ГБ размер диска, который будет создан для каждой локальной ВМ. Значение должно быть не менее 50 ГБ.

Нажать на кнопку Продолжить.

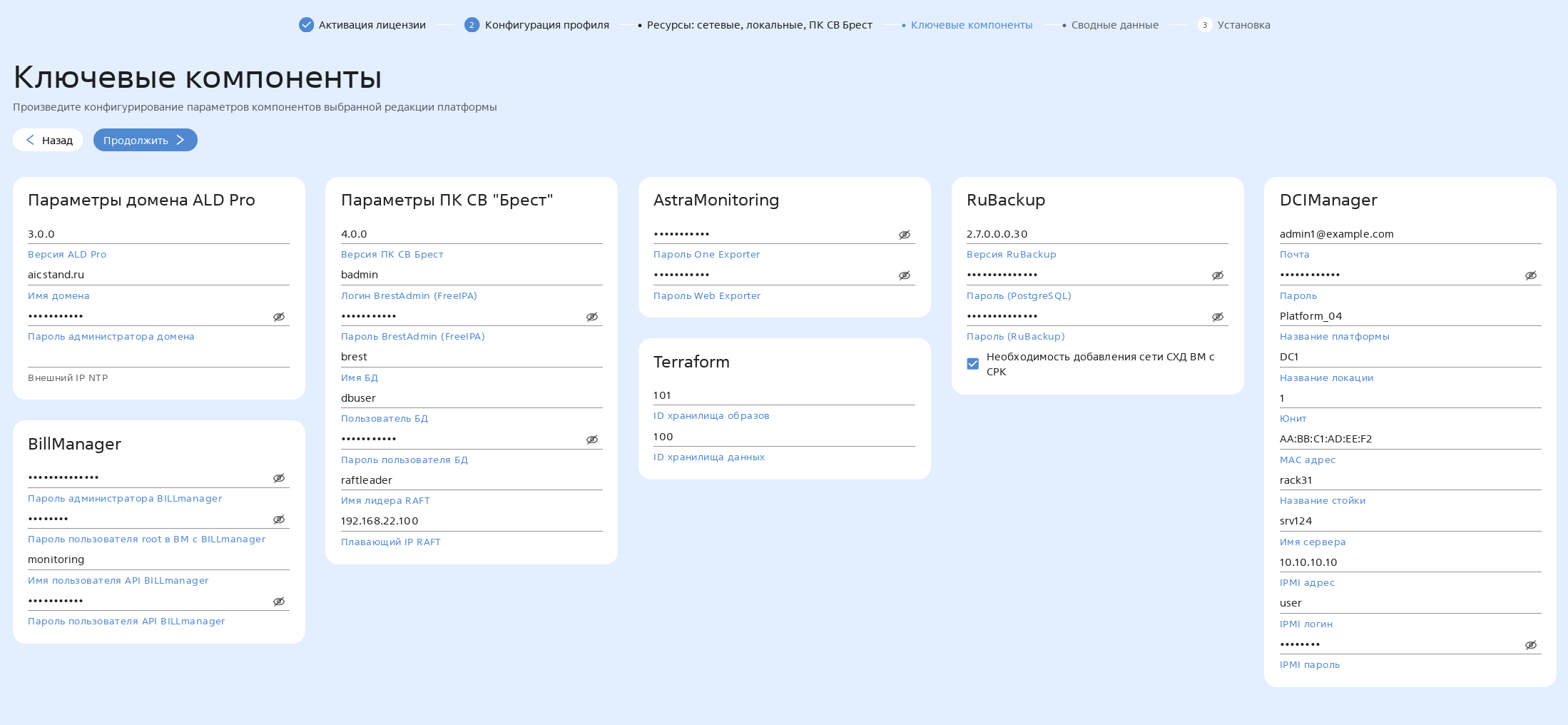

В открывшемся окне Ключевые компоненты задать параметры компонентов Платформы Astra Cloud, в соответствии с выбранной редакцией платформы, а также параметры для возможности их развертывания.

Примечание

Параметры для компонента DCImanager будут присутствовать только в случае, если он был добавлен ранее при заполнении раздела Инфраструктура.

Все компоненты, для которых представлены параметры, будут развернуты в виде ВМ под управлением ПК СВ, кроме ALD Pro и самого ПК СВ «Брест».

Для этого:

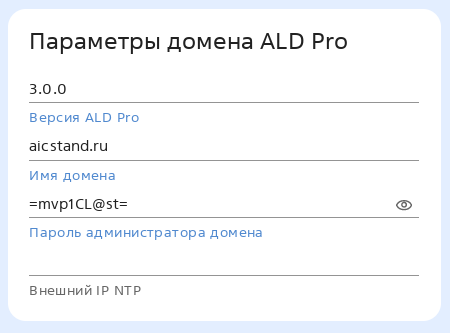

В блоке Параметры домена ALD Pro необходимо:

в поле Версия ALD Pro оставить значение по умолчанию: 3.0.0;

Предупреждение

В данном поле указывается версия Контроллера домена, которая будет развернута в ОП. Указание значения, отличного от 3.0.0, не допускается.

в поле Имя домена указать имя домена ALD Pro, которое будет задано в процессе инсталляции;

в поле Пароль администратора домена задать пароль для административной учетной записи admin, которая будет автоматически создана в контроллере домена.

Примечание

Для входа в веб-интерфейс ALD Pro после его инсталляции необходимо использовать пароль, указанный на данном этапе.

Пароль администратора КД должен:

состоять минимум из 8 символов;

содержать спецсимволы, цифры, буквы нижнего и верхнего регистра;

не содержать в себе следующие спецсимволы:

$,|,!,#,<,>,\,/,(,).

поле Внешний IP NTP оставить пустым.

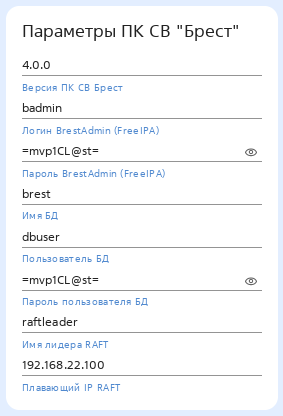

В блоке Параметры ПК СВ «Брест» сконфигурировать базу данных ПК СВ «Брест», пользователя с административными правами, настроить параметры механизма отказоустойчивости RAFT. Для этого:

в поле Версия ПК СВ Брест оставить значение по умолчанию 4.0.0;

Предупреждение

В данном поле указывается версия ПК СВ, которая будет развернута в Платформе Astra Cloud. Указание значения, отличного от 4.0.0, не допускается.

в полях Логин BrestAdmin (FreeIPA) и Пароль BrestAdmin (FreeIPA) задать учетные данные административной учетной записи, которая будет автоматически создана в ПК СВ.

Примечание

Пароль администратора должен:

состоять минимум из 8 символов;

содержать спецсимволы, цифры, буквы нижнего и верхнего регистра;

не содержать в себе следующие спецсимволы:

$,|,!,#,<,>,\,/,(,).

в поле Имя БД указать наименование основной Базы данных ПК СВ.

в полях Пользователь БД и Пароль пользователя БД задать администратора основой базы данных ПК СВ.

Примечание

Минимальные требования к паролю Пользователя БД:

длина не менее 12 символов;

наличие латинских букв и цифр.

в поле Имя лидера Raft задать имя лидера для кластера управления ПК СВ (Raft).

в поле Плавающий IP Raft указать плавающий IP-адрес кластера управления ПК СВ (Raft).

Примечание

Плавающий IP-адрес кластера управления ПК СВ должен быть в Менеджмент сети.

Основная БД ПК СВ «Брест» хранит в себе все данные о кластере ПК СВ «Брест»:

Пользователи и группы: Информация о пользователях, их ролях и группах, а также права доступа.

Виртуальные машины: Данные о конфигурациях виртуальных машин, их состояниях, использовании ресурсов и связанных образах.

Ресурсы: Информация о ресурсах, таких как хосты, хранилища, сети и другие элементы, которые составляют облачную инфраструктуру.

Шаблоны: Настройки и параметры шаблонов для виртуальных машин, которые используются для их создания.

Мониторинг: Данные о производительности, статистике и событиях, связанных с работой виртуальных машин и серверов.

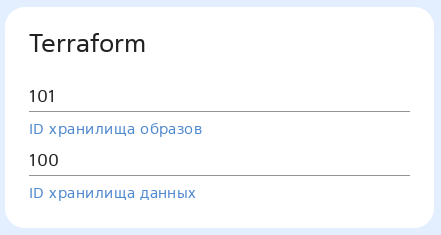

В блоке Terraform указать уникальные идентификатора хранилищ.

Примечание

Создание ВМ под управлением ПК СВ «Брест», виртуальных сетей и иных ресурсов в Платформе Astra Cloud осуществляется через провайдера

Terraform. В связи с тем, что хранилищ может быть больше двух, а их уникальный идентификатор не подлежит ручному изменению, для возможности развертывания ресурсов в ПК СВ «Брест» требуется указать уникальные идентификатора хранилищ.Во время инсталляции будут созданы 2 хранилища: для образов виртуальных машин и для всех данных самих виртуальных машин.

Узнать ID хранилищ можно только после их создания. По завершению определенного этапа будет необходимо вернуться к заполнению этих переменных.

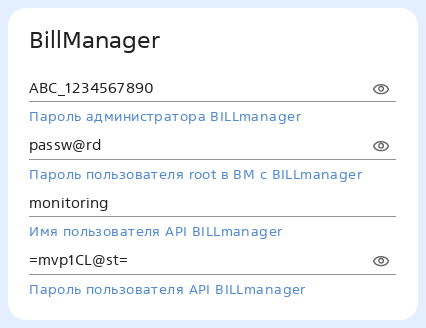

В блоке BILLmanager:

Примечание

BILLmanager — это платформа для автоматизации выдачи сервисов, продажи хостинга и построения публичных облаков. BILLmanager обеспечивает полную автоматизацию бизнеса для облачных, сервис и хостинг-провайдеров: от заказа услуги с сайта до обращения клиента в техническую поддержку.

В рамках инсталляции ОП, для BILLmanager настраивается интеграция с контроллером домена и ПК СВ. BILLmanager является порталом управления Платформы Astra Cloud, через который можно заказывать облачные услуги, создать VDC.

в поле Пароль администратора BILLmanager задать пароль административной учетной записи

admin, которая будет автоматически создана в BILLmanager.в поле Пароль пользователя root в ВМ с BILLmanager задать пароль, который будет задан локальному пользователю

rootв ВМ для BILLmanager.в полях Имя пользователя API BILLmanager и Пароль пользователя API BILLmanager задать учетные данные пользователя, который будет создан в BILLmanager для возможности сборка метрик с ВМ клиентской частью Astra Monitoring.

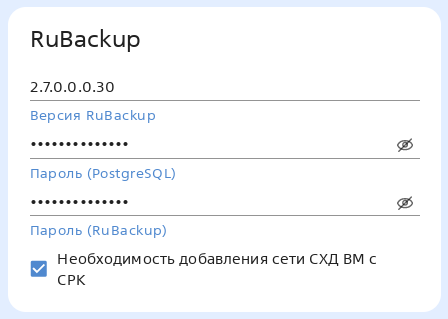

В блоке RuBackup:

Примечание

СРК RuBackup в составе ОП предназначено резервного копирования каталогов и файлов, содержащих конфигурационные файлы ОП. В процессе развертывания СРК RuBackup будет создано расписание для создания их резервных копий.

Клиентами СРК будут серверы КД ALD Pro и серверы управления и виртуализации ПК СВ «Брест».

в поле Версия RuBackup оставить значение по умолчанию 2.7.0.0.0.30;

Предупреждение

В данном поле указывается версия СРК RuBackup, которая будет развернута в ОП. Указание значения, отличного от 2.7.0.0.0.30 не допускается.

в поле Пароль (PostgreSQL) задать пароль пользователя

postgresБД СРК, хранящей все данные СРК;в поле Пароль (RuBackup) задать пароль пользователя

rubackup. Этот пользователь с административными правами будет создан в процессе инсталляции;в поле Необходимость добавления сети СХД ВМ с СРК установить флаг, если ВМ с СРК необходима сеть СХД, и требуется подключение iSCSI LUN диска как блочного хранилища в СРК.

Примечание

Для удобства пользователю

postgresи администратору БД СРК может быть задан одинаковый пароль (не рекомендуется в продуктивной среде).Пароль администратора БД СРК должен:

состоять минимум из 12 символов;

содержать минимум 1 цифру, а также 1 заглавную букву и минимум 1 специальный символ.

не содержать в себе следующие спецсимволы:

(,),!,$,|,/,\.

В блоке Astra Monitoring:

Примечание

Astra Monitoring в составе Платформы Astra Cloud собирает метрики с серверов ALD Pro, серверов управления и виртуализации ПК СВ «Брест», BILLmanager и СРК RuBackup.

Также он имеет настроенную визуализацию метрик позволяющую использовать компонент без дополнительных настроек.

Большая часть данных необходимая для развертывания этого компонента будет получаться автоматически из ранее заполненных переменных, но в процессе инсталляции будут созданы доменные пользователи для корректного сбора метрик. Для гибкости настройки пароли этих пользователей можно поменять.

в поле Пароль One exporter указать пароль пользователя

exporteruser. Этот пользователь будет через API получать данные для метрик Astra Monitoring из ALD Pro и BILLmanager;в поле Пароль Exporter указать пароль пользователя

exporterwebuser. Этот пользователь будет получать данные для метрик с веб-интерфейса ПК СВ.Примечание

Пароли пользователей

exporteruserиexporterwebuserдолжны:состоять минимум из 8 символов;

содержать спецсимволы, цифры, буквы нижнего и верхнего регистра;

не содержать в себе следующие спецсимволы:

$,|,!,#,<,>,\,/,(,).

в полях Имя пользователя API BILLmanager и Пароль пользователя API BILLmanager указать учетные данные пользователя API BILLmanager.

в поле ID обработчика BILLmanager временно оставить значение по умолчанию.

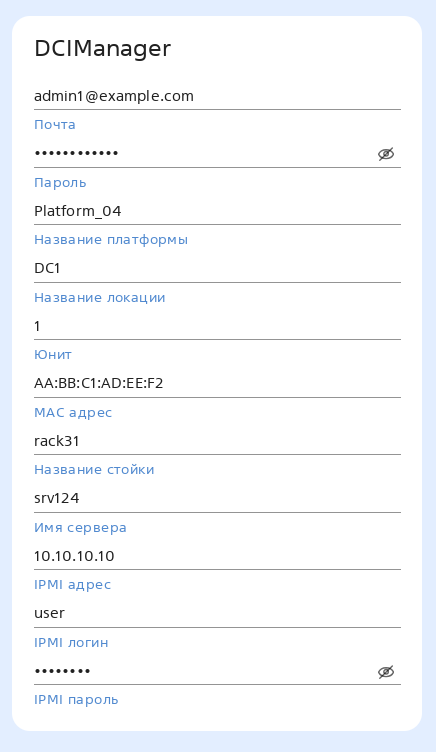

В блоке DCImanager:

Примечание

DCImanager является опциональным компонентом ОП. Блок с его переменными будет доступен только в случае, если он был добавлен в разделе Инфраструктура.

В случае, если планируется его инсталляции в рамках ОП, следует удостовериться, что из официальной документации были скачены два ISO файла —

dci_latest.isoиdci6_repo.iso, и расположены в каталоге/home/astra/iso/dci_manager_iso/на Astra Cloud Installer сервере. Первый ISO образ содержит установочный образ DCImanager, второй ISO образ содержит репозиторий, необходимый для установки DCImanager.Также необходимо удостовериться, что был скачен репозиторий для ALSE 1.7.4.UU1 (файл

base-1.7.4.11-23.06.23_17.13.iso) с его хэш-суммой, оба файла необходимо расположить по пути/home/astra/iso/alse_iso.в поле Почта указать логин для подключения к DCImanager.

Примечание

Указывается именно адрес электронной почты

в поле Пароль задать пароль для подключения к DCImanager.

в поле Название платформы задать наименование платформы, на которой разворачивается DCImanager.

в поле Название локации задать наименование ЦОДа, либо места расположения оборудования.

в поле Юнит указать номер юнита, на котором физически расположен, управляющий локацией, сервер.

в поле MAC адрес задать MAC-адрес управляющего локацией сервера (интерфейса BMC).

в поле Название стойки указать наименование стойки, в которой должен располагаться управляющий локацией сервер.

в поле Имя сервера задать имя управляющего локацией сервера (сетевое имя сервера DCImanager).

Предупреждение

Имя сервера должно начинаться со строчной буквы латинского алфавита.

в полях IPMI адрес, IPMI логин и IPMI пароль задать данные для доступа к IPMI сервера:

Примечание

Данные во всех полях, кроме Почта и Пароль являются шаблонными. Для развертывания DCImanager, при отсутствии подготовленных для него серверов, достаточно поменять только эти значения.

Администратор может подключить к DCImanager 6 оборудование, независимо от его территориального расположения и дата-центра, в котором оно находится. Для этого в платформе есть понятие локации.

Локация — интерфейс, через который DCImanager 6 управляет оборудованием из одного дата-центра. Под каждую локацию в дата-центре отводится специальный сервер, который служит DHCP-сервером и хранилищем шаблонов операционных систем (ОС) для всех серверов в локации. Именно параметры этого сервера задаются в переменных для развертывания.

DCImanager 6 позволяет группировать оборудование в локации по стойкам, в которых оно расположено. При создании локации указывается необходимое количество стоек и их размер в юнитах.

нажать на кнопку Продолжить.

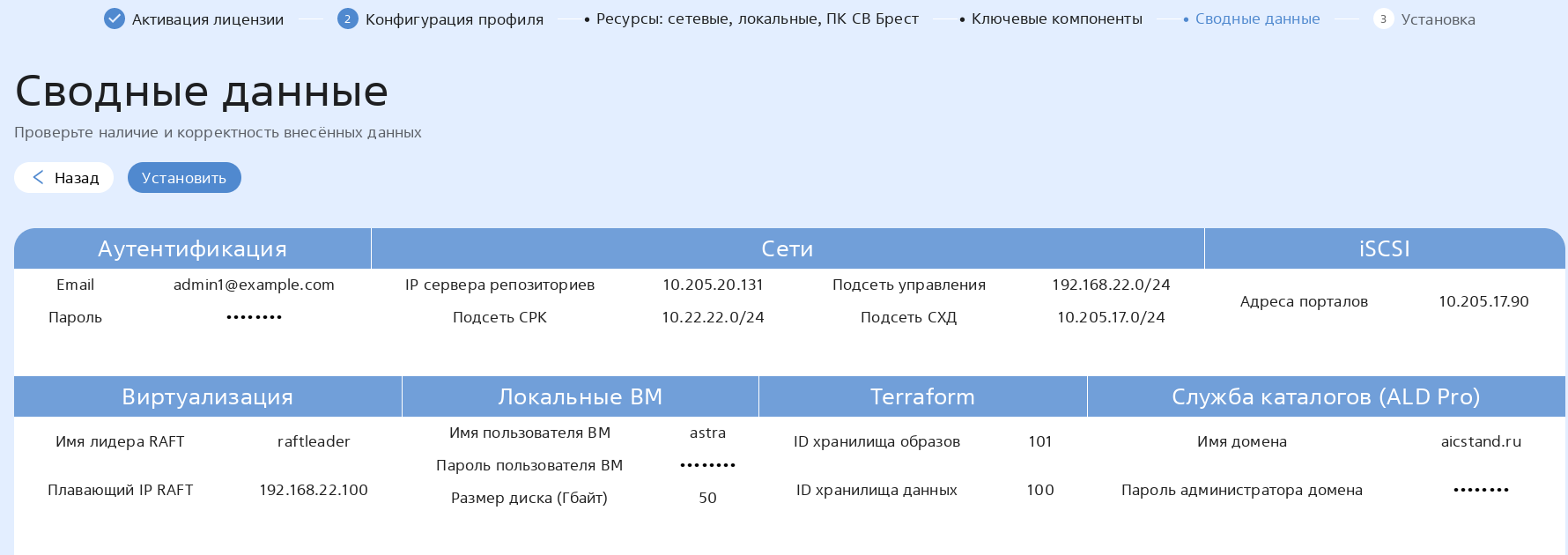

В открывшемся окне Сводные данные ознакомиться с итоговой сводной таблицей, в которой представлены все заполненные в мастере установки данные. При необходимости, нажать на кнопку Назад, для возврата к предыдущему шагу Мастера установки и изменения установленных значений.

Удостоверившись, что все данный заполнены корректно, нажать на кнопку Установить.

Этапы установки#

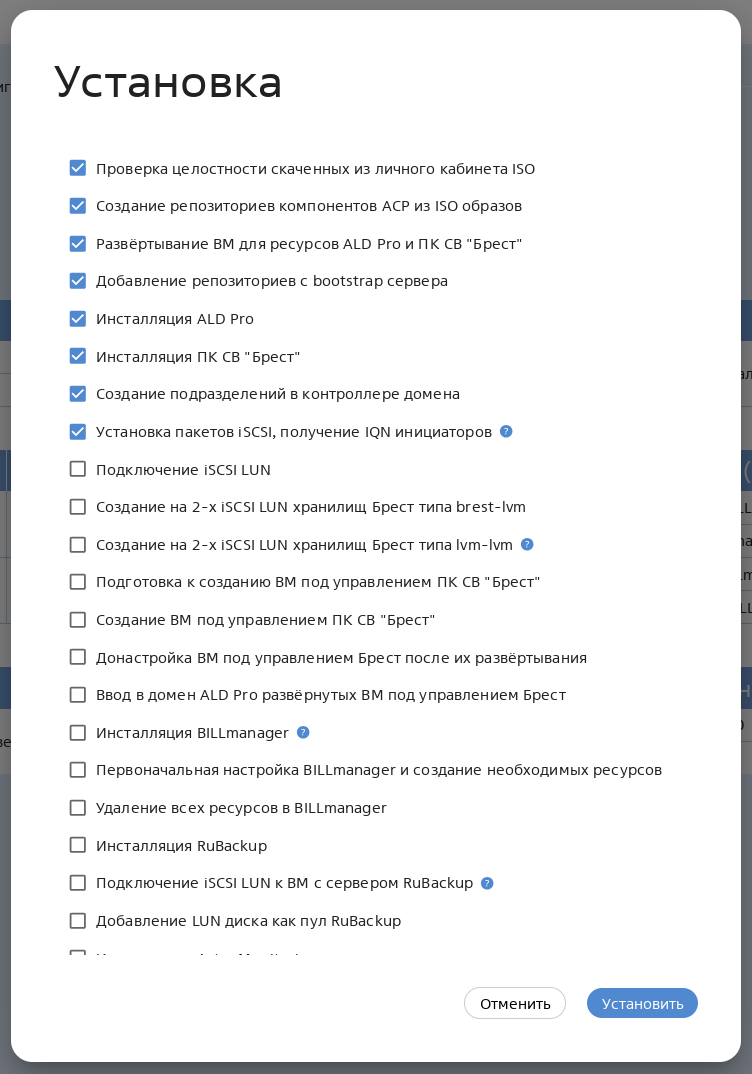

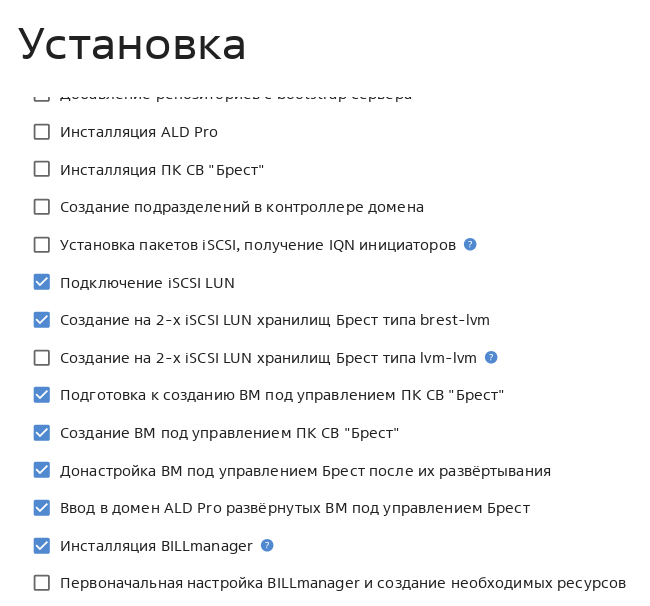

На открывшейся странице Установка будет представлен перечень этапов, необходимых для полной инсталляции Платформы Astra Cloud.

При каждом открытии страницы Установка в списке этапов неизменно будут отмечены первые 8 этапов. Эти 8 этапов можно выполнить подряд без ручного вмешательства, с учетом, что в качестве СХД для ПК СВ будет использован iSCSI.

Для полной инсталляции ОП необходимо запустить от 2 до 4 групп этапов, в зависимости от типа используемого в инсталляции СХД и настроек авторизации инициаторов iSCSI, если он используется в качестве СХД (Рекомендованный вариант).

Первая группа этапов установки#

Первая группа состоит минимум из 7 этапов:

Создание репозиториев компонентов ACP из ISO образов;

Развертывание ВМ для ресурсов ALD Pro и ПК СВ «Брест»;

Добавление репозиториев с bootstrap сервера;

Инсталляция ALD Pro — веб-интерфейс ALD Pro будет доступен по адресу

https://<имя_сервера_кд>.<доменное_имя>;Инсталляция ПК СВ «Брест» — веб-интерфейс ПК СВ будет доступен по адресу

https://<имя_RAFT>.<доменное_имя>;Создание подразделений в контроллере домена;

Установка пакетов iSCSI, получение IQN инициаторов.

На данном шаге необходимо:

Убедиться, что все вышеуказанные этапы отмечены.

Нажать на кнопку Установить.

В зависимости от настроек безопасности, полученные IQN нужно авторизовать на контроллере СХД для подключения LUN дисков для каждого инициатора. В случае если авторизации не требуется, вторая группа будет являться продолжением первой.

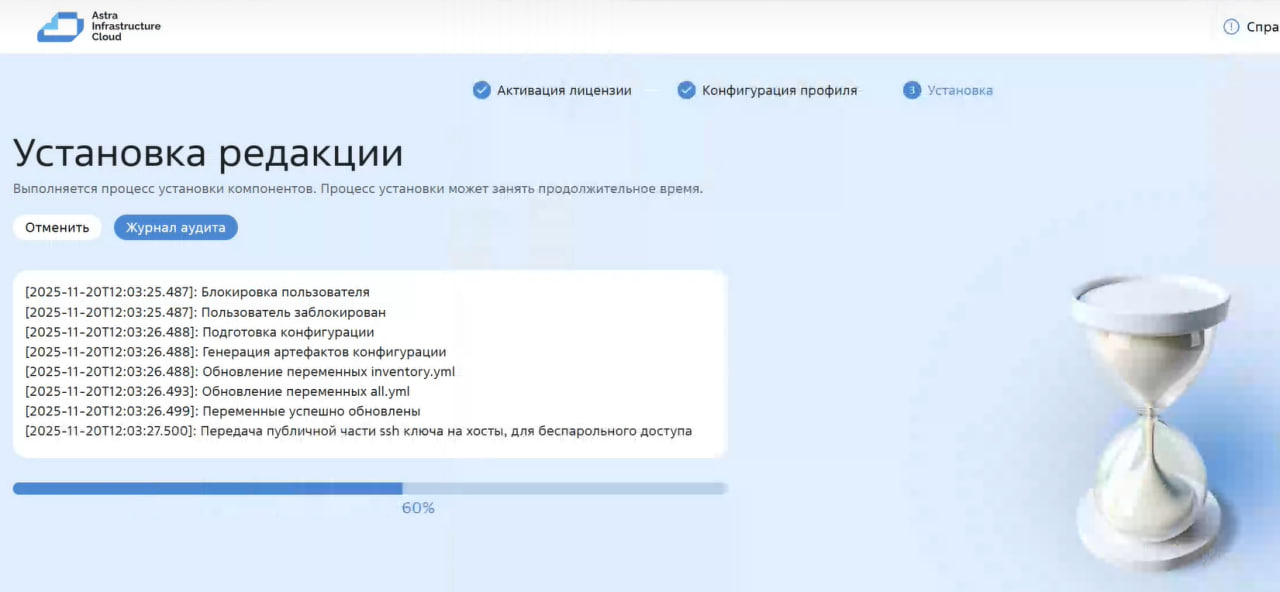

Процесс установки выбранных этапов будет запущен. На экране появится соответствующая информация, с указанием процентного соотношения выполненной работы:

Примечание

По завершении этапа Установка пакетов iSCSI, получение IQN инициаторов, сгенерированные IQN будут отображены в журнале установки.

В случае использования технологии multipathing, подключение LUN-дисков должно быть выполнено вручную.

В случае выбора автоматического подключения и настройки iSCSi (этапы установки от Установка пакетов iSCSi, получение IQN инициаторов до Создание 2 хранилища в ПК СВ «Брест» из 2 наибольших подключенных LUN) необходимо учесть следующее:

во время работы автоматизации на лидера RAFT будут скопированы два шаблона для хранилищ, выбраны два, наибольших по объему, подключенных iSCSI LUN, которые и будут использованы как хранилища для данных и образов ПК СВ;

Примечание

Так как используемые для хранилищ LUN должны быть пусты, в самом начале этого этапа автоматизации происходит проверка на наличие групп томов, физических томов и логических разделов. Если же LUN не пусты и на них есть какие-то компоненты LVM, автоматизация прекратит работу, сообщив о найденных компонентах LVM. Также будет выполнена проверка на идентичность размеров секторов, если размеры логических и физических секторов не будут идентичны, автоматизация остановится и выдаст сообщение об ошибке.

После проверки на наличие компонентов LVM выполняется очистка таблицы командой:

dmsetup

Из таблицы удаляются все записи о ранее созданных виртуальных блочных устройствах. Этот шаг необходим, поскольку при повторном использовании LUN, ранее задействованных в хранилище ПК СВ, наличие старых записей о виртуальных блочных устройствах может помешать их корректной инициализации как новых хранилищ.

ПК СВ не сразу определяет корректные параметры хранилищ, после подключения двух LUN следует подождать 5 минут, чтобы все хранилища корректно инициализировались.

при необходимости использовать хранилища типа LVM_LVM для создания из двух наибольших по размеру LUN хранилищ типа LVM_LVM, следует перейти в интерфейс командной строки Astra Cloud Installer сервера и в директории

/home/astra/aic-codeвыполнить команду:task iscsi_lvm_lvm_datastore

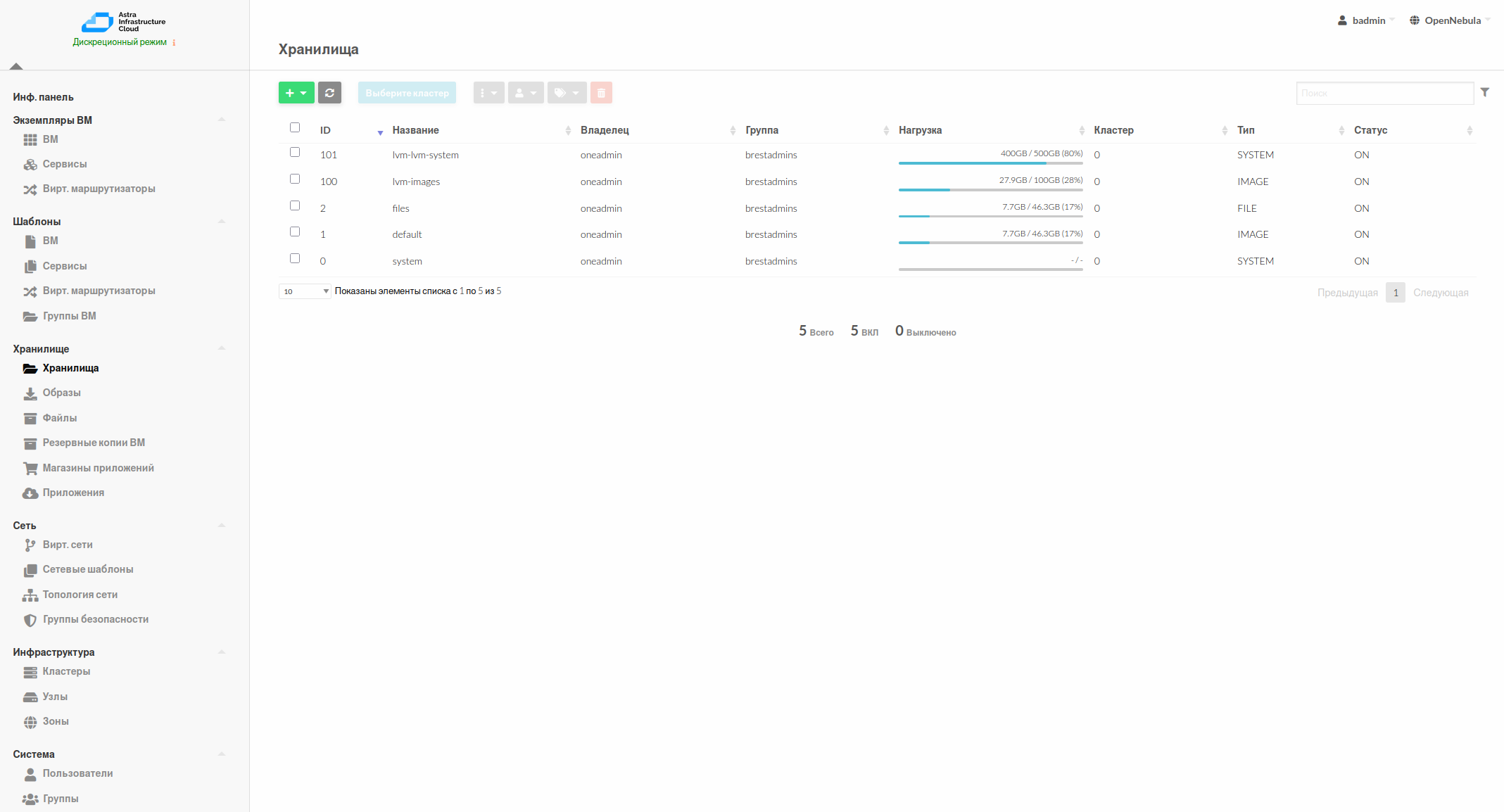

После завершения установки первой группы этапов необходимо подключиться к Порталу администратора (компонент ПК СВ «Брест»), используя, заданный в блоке Параметры ПК СВ «Брест» ключевых компонентов Мастера установки, плавающий IP Raft или Имя лидера Raft, авторизоваться, используя имя и пароль администратора, так же заданные в параметрах ПК СВ «Брест», и проверить корректность создания хранилищ в подсистеме виртуализации.

Примечание

В случае успешного создания хранилищ, следует сохранить скриншот с их идентификаторами, так как данная информация потребуются на этапе установки компонентов Платформы Astra Cloud

. Пример скриншота с идентификаторами хранилищ:

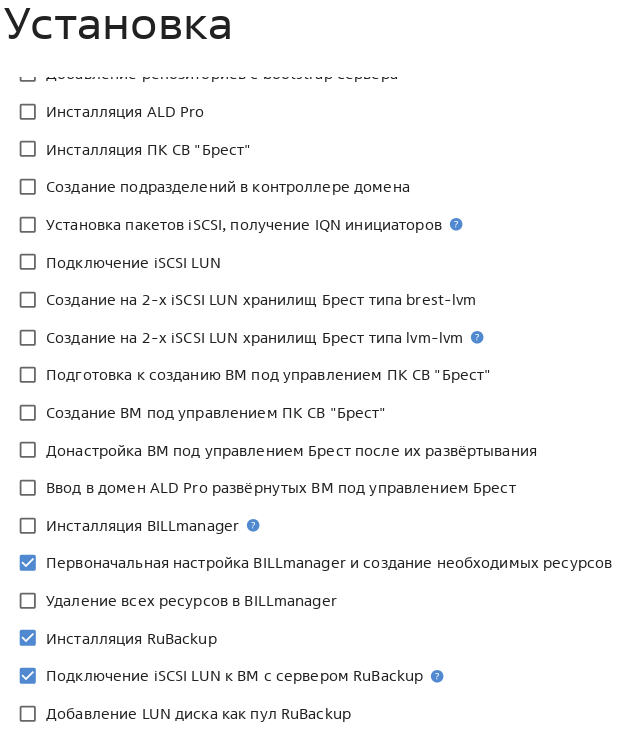

Вторая группа этапов установки#

Вторая группа состоит из следующих этапов:

Подключение iSCSI LUN;

Создание на 2-х iSCSI LUN хранилищ Брест типа brest_lvm или lvm-lvm. Рекомендуемый тип —

brest_lvm, но он возможен только в случае, если размеры логических и физических секторов LUN дисков совпадают. В случае, если в качестве СХД для ПК СВ «Брест» используется не iSCSI, будет необходимо создать из него 2 хранилища вручную;Подготовка к созданию ВМ под управлением ПК СВ «Брест»;

Создание ВМ под управлением ПК СВ «Брест»;

Донастройка ВМ под управлением Брест после их развертывания;

Ввод в домен ALD Pro развернутых ВМ под управлением Брест;

Инсталляция BILLmanager — веб-интерфейс BILLmanager будет доступен по адресу ВМ, на которой он будет установлен.

На данном шаге необходимо:

Убедиться, что все вышеуказанные этапы отмечены.

Нажать на кнопку Установить.

Подсистема развертывания и настройки приступит к созданию необходимых ресурсов для разворачивания компонентов ОП и установки Портала самообслуживания (компонента BILLmanager).

По завершении работы автоматизации будет установленное ПО BILLmanager. Далее необходимо перейти к настройке Портала самообслуживания. Для этого:

Активировать лицензию Портала самообслуживания, выполнив следующие действия:

Подключиться по SSH к ВМ, выполнив в интерфейсе командной строки команду:

ssh <имя_сервисного_пользователя>@<IP_адрес_портала>где:

<имя_сервисного_пользователя>— имя сервисного пользователя, заданного на этапе Сетевая установка ОС;<IP_адрес_портала>— IP-адрес компонента BILLmanager, заданный на этапе Инфраструктура.

Получить идентификатор инсталляции BILLmanager. Он будет записан в файл

inode_id.txtв домашней директории пользователя на ВМ где был развернут BILLmanager:astra@bill-manager:~$ cat inode_id.txt 2239104

Примечание

В случае, если файл будет удален, узнать значение идентификатора инсталляции можно выполнив на сервере с установленным BILLmanager из-под пользователя root команду:

root@bill-manager:~$ ls -i /usr/local/mgr5/etc/billmgr.lic | cut -d' ' -f1 2239104

Значение

inode_idтак же будет сохранено в файлеinode_id.txtв домашней директории пользователя на ВМ, где был развернут BILLmanager.Запросить лицензию в Личном кабинете, либо в службе технической поддержки ISPpsystem, указав значение

inode_id, а также номер приобретенной лицензии и редакцию ОП. После передачи этих данных, будет получена лицензия BILLmanager для его активации. Лицензия имеет длину около 2000 символов.Примечание

Номер лицензии и сама лицензия — это две разные сущности.

После получения лицензии на сервере с установленным BILLmanager, от пользователя

root, выполнить команду:sudo echo <содержимое_файла_полученной_лицензия> > /usr/local/mgr5/etc/billmgr.lic

где

<содержимое_файла_полученной_лицензия>— содержимое файла, полученного как лицензия, чья длина составляет около 2000 символов. Использование иных методов активации лицензии не допускается.Предупреждение

Необходимо выполнять именно команду

echo. Использовать текстовые редакторы для добавления лицензии в файл не допускается.Использование текстовых редакторов изменит уникальный номер инсталляции

inode_id.Веб-интерфейс BILLmanager не будет доступен до активации лицензии. Данный метод активации используется для работы в закрытом контуре.

Перезапустить Портал самообслуживания, выполнив на сервере с BILLmanager команду от имени пользователя

root:/usr/local/mgr5/sbin/mgrctl -m billmgr -R

Примечание

По завершении работы автоматизации, на сервер с BILLmanager в файл

/etc/hostsбудет добавлена запись:127.0.0.1 download.ispsystem.comДанная запись ускорит работу веб-интерфейса BILLmanager в закрытом контуре. В случае установки Платформы Astra Cloud в открытом контуре, — данную запись необходимо удалить, либо закомментировать.

В случае, если BILLmanager будет переустановлен на этой же ВМ, запись нужно будет предварительно удалить.

Третья группа этапов установки#

После активации лицензии BILLmanager следует перейти к третьей группе этапов установки. В нее включены следующие этапы:

Первоначальная настройка BILLmanager и создание необходимых ресурсов;

Примечание

Этап Удаление всех ресурсов в BILLmanager нужно выполнить только, если при создании ресурсов произошла ошибка.

Инсталляция RuBackup;

Подключение iSCSI LUN к ВМ с сервером RuBackup.

На данном шаге необходимо:

Убедиться, что все вышеуказанные этапы отмечены.

Нажать на кнопку Установить.

Как и при подключении iSCSI LUN к серверам управления и виртуализации ПК СВ «Брест», В зависимости от настроек безопасности, полученные IQN нужно авторизовать на контроллере СХД для подключения LUN дисков к ВМ с СРК. В случае, если авторизации не требуется, четвертая группа будет являться продолжением третей.

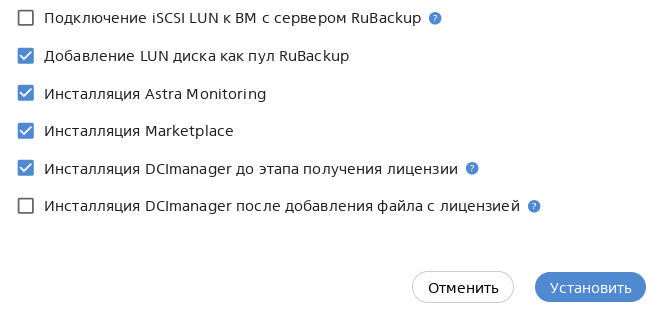

Четвертая группа этапов установки#

В общем случае четвертая группа является последней. Она состоит из следующих этапов:

Добавление LUN диска как пул RuBackup — этап следует запускать только, если ранее к ВМ с СРК был подключен iSCSI LUN;

Примечание

Этап Добавление LUN диска как пул RuBackup является опциональным, но настоятельно рекомендованным для минимизации рисков потери данных и повышения устойчивости к сбоям, так как подключает внешную СХД для СРК RuBackup

Автоматизация рассчитана для использования iSCSI, в случае, если в инсталляции используется другой тип СХД, этапы подключения и настройки LUN диска как пула СРК следует пропустить.

Инсталляция Astra Monitoring — веб-интерфейс административной панели Astra Monitoring будет доступен по адресу ВМ, на которой он будет установлен. Для входа нужно использовать логин

admin-internal, парольadmin. Визуализация собираемых метрик будет доступна по тому же адресу, с добавлением порта3000. Для входа нужно использовать логинadmin, парольpassword;Примечание

Для работы Astra Monitoring необходима лицензия. Для ее получения следует отправить запрос через личный кабинет, выбрав Запрос на услуги, продукт Astra Cloud Platform, компонент Astra Monitoring. Процесс оформления запроса представлен на странице Технической поддержки. Активировать лицензию Astra Monitoring можно как сразу после установки компонента, так и по завершении оставшихся этапов установки.

Инсталляция Marketplace;

Инсталляция DCImanager до этапа получения лицензии.

Примечание

Так как DCImanager является необязательным компонентом ОП, его инсталляция производится на усмотрение администратора ОП. Если развертывание DCImanager планируется, на этом шаге необходимо установить флаг на этапе Инсталляция DCImanager до этапа получение лицензии. Этап инсталляции DCImanager после добавления лицензии запускается отдельно.

На данном шаге необходимо:

Убедиться, что все вышеуказанные этапы отмечены.

Нажать на кнопку Установить.

Если установка DCImanager не планируется, на этом установку компонентов Платформы Astra Cloud следует завершить.

Финальный этап установки (при развертывании DCImanager)#

Если на предыдущем шаге была произведена Инсталляция DCImanager до этапа получения лицензии, после окончания работы автоматизации необходимо завершить процесс установки DCImanager. Для этого:

Перейти во вкладку Журнал установки и найти выведенный уникальный отпечаток установки для получения лицензии DCImanager.

Примечание

Значение этого отпечатка также будет сохранено в файле

fingerprint.txtв домашней директории пользователя на ВМ, где был развернут DCImanager.Пример отпечатка установки:

"fingerprint": "H4sIAAAAAAAA/zXOQW4CMQwF0LtkzSKOHSfmMiM7iUsFGiqGoaoQd2+k0qX1v973M7T9dhvrfXnoZR9bOD5fh3DS7RSOoQA36uauXsgEFHKl1kVjRayJ3YblVEA55jokKo8ZFQVps5klHMI6vpfz+JlYNG/MKqTNtD QHduzoGUr3VrEy1titI8eeTN2YKWESAGGrDm1i10t/Y/PYPj/W5f1oHAiIXVpOqAlAMxcTBkmpapEYaxwmRNlToUxAUJ27NiJNRbRM7n49j/VP3r+63sf/0usXmbnIRCMBAAA="

В личном кабинете авторизоваться и запросить лицензию для DCImanager по полученному в выводе отпечатку. Полученный ответ разместить в файле по пути:

/home/astra/aic-code/ansible/roles/dci_manager/after_license/files, создав файл с именемdci_licenseна Astra Cloud Installer сервере.Примечание

В этом файле должен быть только текст полученной лицензии, в нем не должно быть пустых строк или лишних символов.

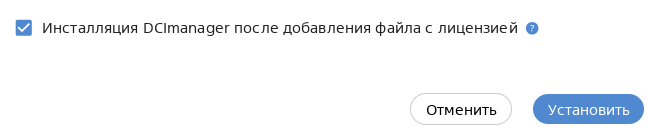

Выполнить финальный запуск** Мастера Установки**, выбрав в этапах установки последний пункт: Инсталляция DCImanager после добавления файла с лицензией. Нажать на кнопку Установить.

После завершения работы Мастера установки, перейти к настройке DCImanager. Для этого:

Открыть кабинет DCImanager по адресу:

https://<IP_адрес_DCI>Авторизоваться, использовав для входа учетные данные, заданные при конфигурировании DCImanager.

Нажать на кнопку Войти:

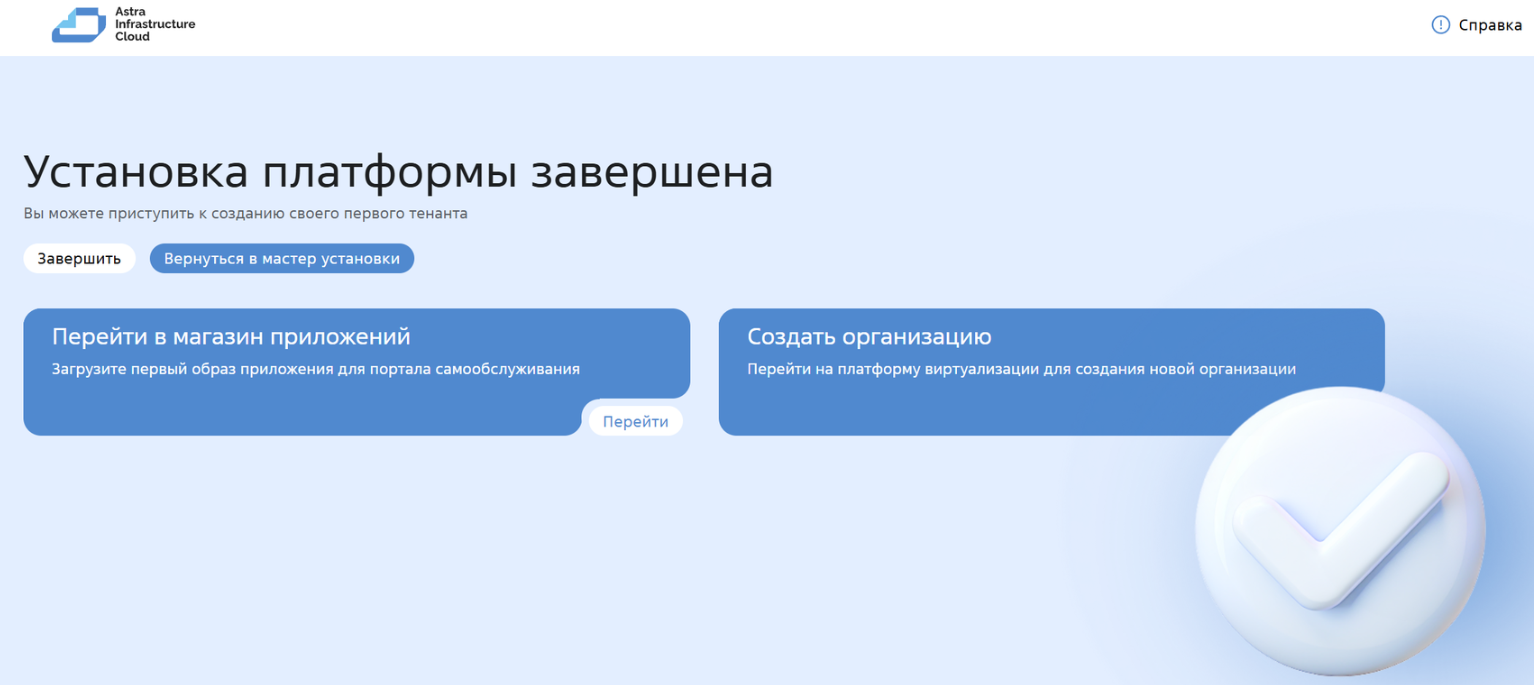

На этом установка всех компонентов ОП будет завершена.

Проверка результатов установки#

Проверка установки КД ALD Pro#

После успешного развертывания КД, следует перейти в веб-интерфейс ALD Pro, чтобы удостовериться, что все нужные серверы вошли в домен. Для этого:

В браузере одного из серверов, на которых были развернуты ВМ, перейти по адресу:

https://<IP_КД>где

<IP_КД>— IP-адрес созданного контроллера домена (в данном примере:https://dc1-test.aicstand.ru) .Авторизоваться под учетной записью администратора КД.

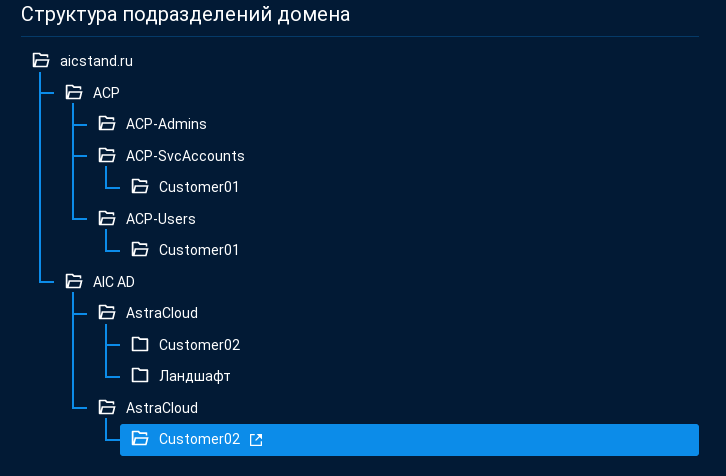

3. Для проверки создания организационной структуры домена выбрать пункт меню слева: Пользователи и компьютеры — Организационная структура. Структура должна иметь следующий вид:

Структура организована по двум основным разделам:

ACP — для управления административными и пользовательскими ресурсами;

AIC AD — для управления облачными ресурсами и клиентскими аккаунтами с разделением на тенантную и сервисную структуры управления.

Также будет создан пользовать astracloud_user, он является примером пользователя для работы с VDC. Пароль пользователя — ABC_1234567890.

Примечание

Данная структура является примером, опираясь на который, можно создавать актуальные структуры для активной инфраструктуры.

Проверка работы подсистемы мониторинга Astra Monitoring#

Для проверки работы подсистемы мониторинга необходимо:

Перейти в веб-интерфейс Astra Monitoring по адресу:

<IP_адрес_AM>;Войти в веб-интерфейс Astra Monitoring (логин и пароль по умолчанию

admin-internal/adminможет быть изменен после развертывания);ерейти по адресу:

<IP_адрес_AM>:3000для доступа к сервису визуализации собираемой информацииGrafana;Войти в сервис

Grafana(логин и пароль по умолчаниюadmin/passwordможет быть изменен после развертывания);При первом входе принять условия лицензионного соглашения, нажав на кнопку Принять в правом нижнем углу экрана:

Предупреждение

Системное время на сервере, с которого осуществляется вход на портал

Grafana, должно совпадать со временем на серверах контроллера домена.Перейти в раздел Объекты наблюдения — Объекты.

Проверка работы СРК RuBackup#

На этапе развертывания СРК выполняются следующие действия:

все клиенты RuBackup автоматически авторизуются на сервере СРК.

создаются клиентские группы:

dc,brest,rubackup, по ним распределяются все клиенты.В клиентскую группу

rubackupпереносится клиент самого сервера RuBackup, в группуdc— контроллер домена и его реплики, в группуbrest— серверы управления и виртуализации ПК СВ.для каждого клиента (кроме клиента самого сервера RuBackup) создаются правила глобального расписания резервного копирования каталогов и файлов содержащих конфигурационные файлы ОП.

для каждого клиента СРК создается расписание создания РК директорий

/home, /etc, /root. На всех клиентах, кроме сервера СРК, создается расписание РК директории/opt/rubackup, на сервере СРК создается расписание РК директории/opt/rubackup/etc.Для лидера КД создание расписание создания РК FreeIPA как ресурса, для всех серверов управления ПК СВ создания РК директории

/var/lib/one,/backup.Ссоздание РК по расписанию выполняется ежедневно, с 00:00, между запуском каждого расписания есть интервал в 5 минут.

У СРК также есть веб-интерфейс, для входа в который требуется авторизовать API токен RuBackup.

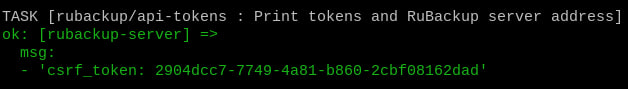

Для этого, находясь на установочном сервере Платформы Astra Cloud, от имени пользователя astra в директории /home/astra/aic-code выполнить команду:

task rubackup_token

Итогом автоматизации будет вывод (CSRF-токен) формата:

Для удобства, токен из вывода автоматизации так же записывается в файл /home/astra/api-tokens на сервере СРК.

Пример содержания файла с токеном CSRF:

astra@rubackup-server:~$ cat /home/astra/api-tokens

# BEGIN ANSIBLE MANAGED BLOCK

csrf_token: 2904dcc7-7749-4a81-b860-2cbf08162dad

# END ANSIBLE MANAGED BLOCK

Примечание

Авторизовывать токен нужно только для работы веб-интерфейса СРК — Tucana.

После завершения развертывания Astra Monitoring необходимо заново получить и авторизовать токен. Команда для его генерации представлена ниже.

Для авторизации CSRF-токена REST API выполнить следующие действия:

В веб-браузере ВМ с СРК перейти по адресу:

https://api.rubackup.local:5656/api/v1В верхнем правом углу открывшегося окна нажать на кнопку Authorize:

Ввести полученный в выводе CSRF-токен.

Примечание

Подключение к ВМ

Для подключения к удаленному столу ВМ рекомендуется использовать VNC-подключение, или XRDP. Для VNC-подключения необходимо установить соответствующий пакет:

sudo apt install virt-viewer

Далее в веб-интерфейсе ПК СВ нужно выбрать Подключение через VNC, после открыть скаченный файл командой:

remote-viewer имя_скаченного_файла.vvПри перезагрузке RuBackup сервера, либо службы

rubackup_server.service, токен для REST API нужно будет генерировать и авторизовывать заново.Для выполнения генерации нового токена, без необходимости повторно запускать весь процесс развертывания, на Astra Cloud Installer сервере в директории

/home/astra/aic-codeвыполнить команду:task rubackup_token

Для проверки работы подсистемы резервного копирования следует:

Войти в Портал администратора;

Выбрать в списке ВМ компоненты СРК;

Перейти в графическую консоль ВМ;

Примечание

Для подключения к удаленному столу ВМ рекомендуется использовать внешний клиент либо VNC-подключение. Для установки внешнего клиента выполнить команду:

sudo apt install virt-viewer

Далее на Портале Администратора загрузить файл для ПО Virt Viewer либо выбрать подключение к консоли VNC через веб-браузер:

При подключении с использованием ПО Virt Viewer выполнить команду:

remote-viewer <имя_скаченного_файла>.vvДля открытия оконного приложения в графической консоли выполнить команду:

rbm

В открывшемся окне для входа в систему:

в поле Имя сервера RuBackup указать имя сервера (можно использовать

localhostлибо IP-адрес самой ВМ);в поле Имя пользователя ввести значение rubackup;

в поле Пароль ввести пароль, заданный в блоке RuBackup на этапе Ключевые компоненты Мастера установки (в поле Пароль для входа в RBM)

Тип аутентификации оставить по умолчанию. Нажать на кнопку Войти;

После входа в систему удостовериться, что все клиенты СРК авторизованы, находятся в сети, распределены по группам. В разделе Глобальное расписание созданы расписания для создания РК каталогов и файлов, содержащих конфигурационные файлы Платформы Astra Cloud. В случае подключения внешнего СХД, после соответствующего этапа в разделе Хранилища, подразделе Пулы будет представлен пул с именем

iscsi_pool, а в подразделе Блочные устройства будет указан LUN диск.

Проверка работы Магазина приложений#

Автоматизация, выполняемая на ВМ с маркетплейсом, отправляет специальный API-запрос, после которого с определенной периодичностью, примерно раз в 10 минут, ПК СВ будет связываться с этой ВМ и получать из нее доступные сервисы, публикуя их в магазине приложений aic_marketplace.

Пример содержания магазина приложений aic_marketplace:

Из примера видно что GitFlic доступен как сервис для размещения в ПК СВ. Для развертывания сервиса необходимо выбрать его шаблон (он всегда будет иметь тип ШАБЛОН СЕРВИСА). Открыв шаблон сервиса, его необходимо загрузить в хранилище ПК СВ. Для этого нужно нажать на кнопку Импорт в хранилище:

В открывшемся окне, выбрав хранилище для загрузки, следует выбрать пункт Загрузить, после чего в ПК СВ будет создан шаблон сервиса, шаблон ВМ с этим сервисом, а также сам сервис будет загружен в качестве образа в хранилище образов ПК СВ.

После того как образ будет загружен (перейдет в статус ГОТОВО), для размещения сервиса необходимо перейти в раздел Шаблоны, подраздел Сервисы. В этом списке шаблонов сервисов появится шаблон загруженного сервиса:

Открыв шаблон сервиса, из него можно создать ВМ, нажав на кнопку Создать экземпляр:

Указав сети, которые будет использовать сервис, и задав ВМ имя, можно запустить ее создание. После создания ВМ будет отображаться в списке всех ВМ в разделе Экземпляры ВМ.

Примечание

Имя пользователя этой ВМ — astra, пароль — astra.

Веб-интерфейс GitFlic будет доступен по адресу ВМ, по протоколу http. Для входа, в графе почта нужно указать adminuser@admin.local, пароль — qwerty123

Возможные ошибки и их решение#

Ошибки при создании компонентных ВМ#

На этапе Создание ВМ под управлением ПК СВ «Брест» загружаются Qcow2 образы ВМ, создаются сети, ВМ, шаблоны для каждой ВМ.

Повторный запуск этого этапа, в случае ручного удаления части созданных развертыванием ресурсов, возможен только после полного ручного удаления всех ресурсов, развернутых ранее этапом по их созданию, а также выполнения этапа Удаление всех ресурсов в ПК СВ «Брест».